Jeszcze kilka lat temu trudno było sobie wyobrazić, że sztuczna inteligencja nie tylko zagra na pianinie, ale skomponuje oryginalną muzykę do filmu czy gry w kilka minut. W 2026 roku AIVA realnie zmienia zasady gry w branży muzycznej – od procesu komponowania, przez ocenę jakości, aż po kwestie praw autorskich i integrację z narzędziami produkcyjnymi. Jak działa AI w komponowaniu utworów? Czy muzyka z AIVA dorównuje tej tworzonej przez ludzi? Jak wygląda workflow i co o tym myślą profesjonaliści? Zapraszam do praktycznego przeglądu technologii, prawa i etyki, które dziś współtworzą muzyczną rewolucję.

📋Na skróty

AIVA – jak działa sztuczna inteligencja w komponowaniu muzyki?

Proces tworzenia utworu przez AIVA: technologia i algorytmy w praktyce

Zastosowania AIVA w branży muzycznej – realne przykłady i możliwości

Jakość utworów AIVA vs. muzyka twórców ludzkich – analiza i opinie profesjonalistów

AIVA a prawa autorskie – wyzwania prawne i wynagradzanie artystów w 2026 roku

Integracja AIVA z narzędziami produkcyjnymi – workflow i praktyczne wskazówki

Refleksja: Jak AI zmienia kreatywność i przyszłość muzyki?

Społeczne i etyczne konsekwencje powszechnego użycia AI w muzyce

Kluczowe wnioski

- AIVA umożliwia szybkie generowanie oryginalnych utworów muzycznych na bazie analizy milionów partytur i nagrań, otwierając nowe możliwości dla twórców i firm medialnych.

- Integracja AIVA z popularnymi DAW-ami (np. Ableton, Logic Pro) przyspiesza workflow producentów oraz pozwala na łatwe dostosowanie AI do własnych potrzeb i stylu pracy.

- Jakość muzyki tworzonej przez AIVA dorównuje kompozycjom ludzkim w wielu zastosowaniach komercyjnych, jednak wciąż wywołuje dyskusje w środowisku profesjonalnych muzyków i kompozytorów.

- Korzystanie z AI w muzyce rodzi nowe wyzwania prawne – właścicielem praw do utworu może być zarówno użytkownik narzędzia, jak i podmiot dostarczający AI, co wymaga ścisłego sprawdzenia licencji i modeli wynagradzania.

- Upowszechnienie AI w branży muzycznej wpływa na rynek pracy, modele wynagrodzeń oraz debatę o kreatywności i przyszłości zawodów artystycznych, zmuszając firmy i artystów do redefinicji ról oraz strategii działania.

AIVA – jak działa sztuczna inteligencja w komponowaniu muzyki?

Dla producentów muzycznych, twórców gier czy agencji reklamowych, AIVA otwiera dostęp do oryginalnych kompozycji w kilka minut. W praktyce użytkownik wybiera styl, tempo, instrumentarium, a system generuje utwór, który można bezpośrednio wykorzystać w projekcie lub dowolnie modyfikować. Z perspektywy biznesowej to ogromna oszczędność czasu i kosztów – nie trzeba angażować kompozytora przy każdym projekcie, a jednocześnie można uzyskać muzykę dopasowaną do konkretnej potrzeby.

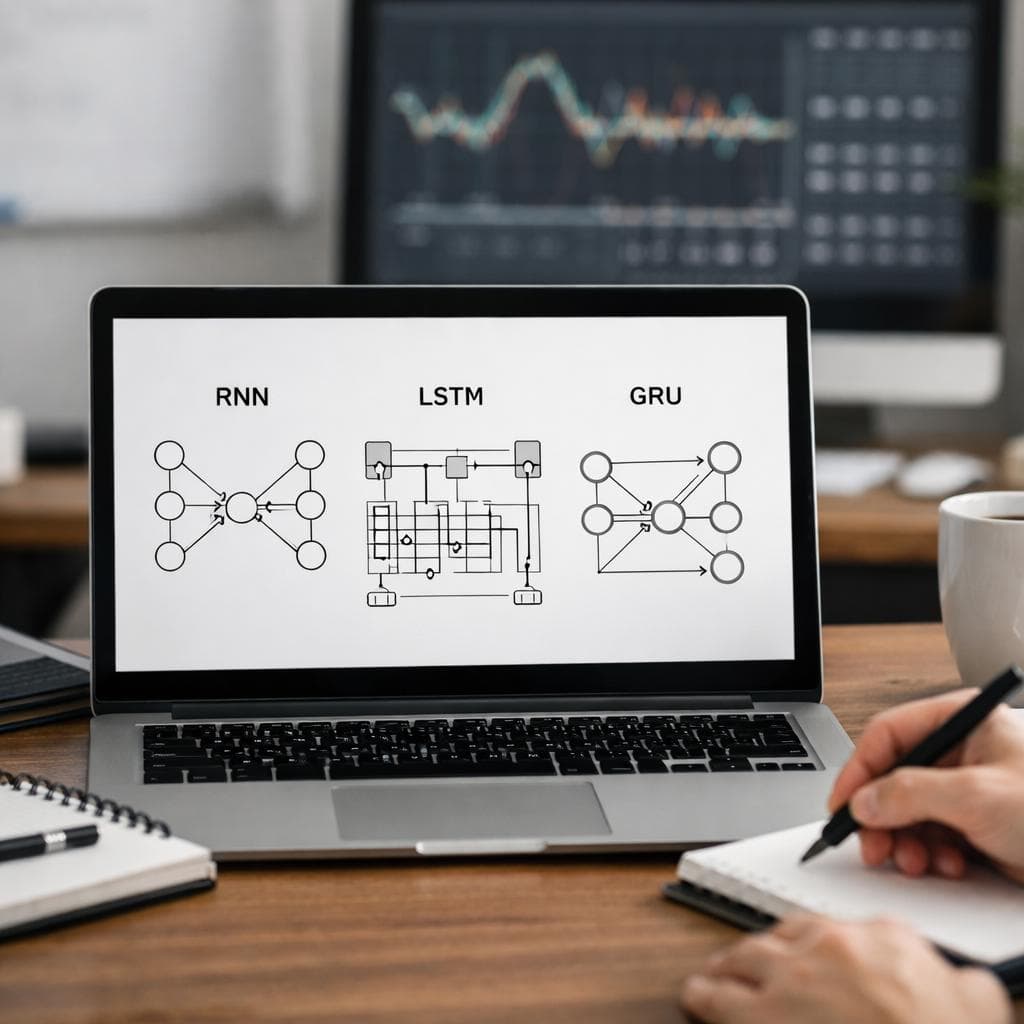

Technologicznie AIVA korzysta z frameworków TensorFlow i PyTorch oraz własnych silników analizy dźwięku. W tym kontekście warto zwrócić uwagę na różne podejścia do wykonywania operacji w środowiskach programistycznych, takie jak Eager Execution vs Lazy Execution, ponieważ wybór strategii wykonania ma realny wpływ na szybkość generowania oraz modyfikowania muzyki przez AI. Przetwarza dane zarówno w formacie MIDI, jak i audio, co umożliwia generowanie nie tylko melodii, ale też pełnych aranżacji. W 2026 roku system integruje się z popularnymi DAW-ami (Ableton Live, FL Studio, Logic Pro X), co ułatwia komponowanie bezpośrednio w środowisku pracy muzyka.

Z punktu widzenia kreatywności, AIVA nie ogranicza się do kopiowania istniejących schematów. Jej modele potrafią łączyć inspiracje z różnych epok i gatunków, tworząc nietypowe połączenia, które trudno byłoby wygenerować ręcznie. To narzędzie dla tych, którzy chcą eksperymentować, ale też dla firm szukających unikalnej ścieżki dźwiękowej bez ryzyka naruszenia praw autorskich.

Dzięki ciągłemu uczeniu się na nowych danych, AIVA stale podnosi jakość generowanych utworów. Opinie profesjonalnych muzyków pokazują, że w wielu przypadkach trudno rozpoznać, czy dany utwór stworzył człowiek, czy AI. Dla branży muzycznej oznacza to realną zmianę paradygmatu: sztuczna inteligencja staje się partnerem twórczym, a nie tylko narzędziem automatyzującym pracę.

Proces tworzenia utworu przez AIVA: technologia i algorytmy w praktyce

| Etap | AIVA | Tradycyjny kompozytor |

|---|---|---|

| Analiza stylu | Automatyczna, na podstawie danych muzycznych | Manualna, oparta na doświadczeniu i słuchu |

| Generowanie szkicu | Poniżej 1 minuty | Od kilku godzin do kilku dni |

| Dopasowanie do briefu | Parametryzacja przez użytkownika | Indywidualna interpretacja briefu |

| Finalizacja utworu | Automatyczna, z możliwością edycji | Manualna, często przy udziale zespołu |

| Czas realizacji | Od kilku minut do kilku godzin | Od kilku dni do kilku tygodni |

Zastosowania AIVA w branży muzycznej – realne przykłady i możliwości

Automatyzacja procesu komponowania z wykorzystaniem AIVA zmienia sposób pracy zarówno niezależnych twórców, jak i dużych studiów produkcyjnych. W 2026 roku narzędzia AI, takie jak AIVA, są wykorzystywane nie tylko przez profesjonalistów, ale również przez amatorów, startupy oraz agencje reklamowe, które potrzebują szybkiej i legalnej muzyki do swoich kampanii. Przewaga tego rozwiązania polega na natychmiastowym generowaniu oryginalnych utworów dopasowanych do konkretnych wymagań projektu – od stylu muzycznego po określony nastrój czy tempo.

W praktyce AIVA znajduje zastosowanie w wielu segmentach rynku. Twórcy gier komputerowych, tacy jak Bloober Team czy CD Projekt, wykorzystują AI do prototypowania ścieżek dźwiękowych i dynamicznego generowania muzyki zależnej od akcji w grze. W branży filmowej platformy streamingowe oraz domy produkcyjne korzystają z AIVA przy tworzeniu muzyki do zwiastunów, seriali czy filmów dokumentalnych. Coraz częściej AI wspiera także nauczycieli muzyki i edukatorów, pozwalając personalizować materiały dydaktyczne lub analizować styl kompozytorski znanych twórców.

Z punktu widzenia biznesowego AIVA umożliwia znaczące obniżenie kosztów produkcji muzyki oraz przyspiesza realizację projektów wymagających dużej liczby utworów – np. w reklamie, gdzie liczy się szybkość reakcji na potrzeby klienta. Dla muzyków i producentów to szansa na szybkie przygotowanie demo czy inspiracji, które mogą zostać dalej rozwinięte przez człowieka. Warto dodać, że integracja AIVA z popularnymi narzędziami DAW, takimi jak Ableton Live czy Logic Pro X, pozwala na płynny workflow i łatwe modyfikacje utworów bezpośrednio w środowisku produkcyjnym.

- Generowanie oryginalnych ścieżek dźwiękowych do gier komputerowych oraz aplikacji mobilnych.

- Tworzenie muzyki do reklam telewizyjnych, radiowych i internetowych na zlecenie agencji marketingowych.

- Komponowanie podkładów muzycznych do filmów, seriali, dokumentów oraz zwiastunów przez studia filmowe.

- Wspieranie edukacji muzycznej: automatyczne generowanie ćwiczeń, analizowanie stylów kompozytorów, personalizacja nauki.

- Szybkie tworzenie muzyki na potrzeby podcastów, vlogów i platform streamingowych (np. YouTube, Spotify).

- Prototypowanie i inspiracja dla profesjonalnych kompozytorów oraz producentów muzycznych.

Rosnąca dostępność rozwiązań takich jak AIVA sprawia, że coraz więcej firm i twórców indywidualnych korzysta z AI nie tylko do przyspieszania pracy, ale też do eksperymentowania z nowymi formami ekspresji muzycznej. W 2026 roku integracja AI z produkcją muzyczną staje się standardem w wielu segmentach rynku, a znajomość tych narzędzi to realna przewaga zarówno dla biznesu, jak i artystów.

Jakość utworów AIVA vs. muzyka twórców ludzkich – analiza i opinie profesjonalistów

| Cechy | Utwory AIVA | Utwory ludzkich kompozytorów |

|---|---|---|

| Oryginalność | Średnia, przewidywalne schematy | Wysoka, zaskakujące rozwiązania |

| Emocje | Poprawne, lecz powierzchowne | Głębokie, wielowarstwowe |

| Technika wykonania | Bardzo dobra, bezbłędna | Zróżnicowana, czasem celowo niedoskonała |

| Spójność stylistyczna | Wysoka, powtarzalna | Różnorodna, elastyczna |

| Reakcja odbiorców | Pozytywna w zastosowaniach użytkowych | Silne zaangażowanie emocjonalne |

AIVA a prawa autorskie – wyzwania prawne i wynagradzanie artystów w 2026 roku

Nowe wyzwania prawne: kto jest właścicielem muzyki generowanej przez AI?

Pojawienie się narzędzi takich jak AIVA wprowadziło poważne zamieszanie w interpretacji praw autorskich. W polskim i europejskim prawie autorskim wciąż nie ma jednoznacznej odpowiedzi, kto formalnie jest autorem utworu wygenerowanego przez sztuczną inteligencję – twórca algorytmu, użytkownik narzędzia czy może właściciel platformy. Dla firm medialnych, producentów oraz niezależnych artystów oznacza to realne ryzyko prawne przy komercjalizacji utworów wygenerowanych przez AI. W 2026 roku trwają prace legislacyjne w Unii Europejskiej nad ujednoliceniem przepisów dotyczących „autorstwa AI”, jednak rynek funkcjonuje w stanie niepewności. Przykładowo, platformy takie jak Soundraw czy Amper Music jasno określają w regulaminach, komu przysługuje prawo do komercyjnego wykorzystania wygenerowanych utworów, ale nie wszystkie rozwiązania AI oferują taką transparentność.- Brak jednolitych regulacji prawnych dotyczących utworów wygenerowanych przez AI (UE, USA, Polska)

- Niejasność w zakresie autorstwa oraz odpowiedzialności za naruszenia praw autorskich

- Modele licencyjne – od pełnego przeniesienia praw na użytkownika po ograniczone licencje

- Ryzyko naruszenia praw do materiałów źródłowych, na których trenowano AI

- Problemy z egzekwowaniem wynagrodzeń dla artystów, których style lub fragmenty twórczości zostały użyte do trenowania modeli AI

Modele wynagradzania i licencjonowania w praktyce

W 2026 roku firmy oferujące AI do generowania muzyki stosują różne modele licencjonowania. Część platform, jak AIVA, umożliwia użytkownikom wykorzystywanie wygenerowanych utworów komercyjnie w ramach wykupionej subskrypcji lub jednorazowej opłaty. Inne, jak Ecrett Music, zastrzegają sobie prawo do ograniczeń w użyciu utworów, zwłaszcza w projektach reklamowych czy medialnych. W branży pojawiają się pierwsze systemy rozliczeń hybrydowych – część przychodów z komercyjnego wykorzystania muzyki trafia do twórców danych treningowych, jeśli zostaną zidentyfikowani. Jednak brak standardów i automatycznych narzędzi do egzekwowania takich rozwiązań sprawia, że wynagradzanie artystów pozostaje wyzwaniem, zwłaszcza w skali międzynarodowej.Wpływ AI na prawa twórców i przyszłość branży muzycznej

Szybkie upowszechnienie AI w muzyce wymusza debatę nie tylko o prawach autorskich, lecz także o modelach współpracy między twórcami, firmami technologicznymi i platformami dystrybucyjnymi. Coraz więcej artystów i organizacji zbiorowego zarządzania (np. ZAiKS, BMI) domaga się udziału w przychodach generowanych przez AI, jeśli ich twórczość była użyta do trenowania modeli. Jednocześnie powstają inicjatywy mające na celu oznaczanie utworów stworzonych przez AI oraz wdrażanie rozwiązań blockchain do śledzenia praw własności. Dla biznesu oznacza to konieczność śledzenia zmian legislacyjnych i świadomego wyboru narzędzi AI, które gwarantują transparentność i bezpieczeństwo prawne.Integracja AIVA z narzędziami produkcyjnymi – workflow i praktyczne wskazówki

Dlaczego integracja AIVA z DAW-ami to realna przewaga?

Integracja AIVA z cyfrowymi stacjami roboczymi audio (DAW) stała się jednym z najważniejszych tematów dla producentów muzycznych, kompozytorów oraz twórców ścieżek dźwiękowych w 2026 roku. Umożliwia błyskawiczne przeniesienie wygenerowanych przez AI utworów do środowiska produkcyjnego, gdzie można je dowolnie edytować, miksować i masterować. Dla freelancerów, agencji reklamowych czy studiów postprodukcyjnych to szansa na skrócenie czasu realizacji projektów nawet o 40–60%. Z kolei dla początkujących muzyków czy youtuberów, integracja AIVA z popularnymi DAW-ami (Ableton Live, FL Studio, Logic Pro X, Cubase) otwiera dostęp do profesjonalnych workflow bez konieczności posiadania zaawansowanej wiedzy kompozytorskiej.Jak wygląda workflow z AIVA w praktyce?

Współpraca AIVA z DAW-ami opiera się na eksporcie projektów w formatach MIDI, WAV lub STEMS. Po wygenerowaniu utworu w AIVA użytkownik może pobrać poszczególne ścieżki instrumentów i zaimportować je bezpośrednio do swojego projektu w DAW. Pozwala to na dalszą edycję aranżacji, zmianę instrumentacji, dodanie efektów czy automatyzacji. Zaawansowane integracje, np. przez VST/AU pluginy, umożliwiają nawet sterowanie parametrami AI w czasie rzeczywistym z poziomu DAW. Na polskim rynku najczęściej wykorzystywane są integracje z FL Studio, Ableton Live oraz Logic Pro X, co pozwala twórcom zachować pełną kontrolę nad procesem produkcji.- Wygeneruj utwór w AIVA – wybierz styl, długość, instrumentarium.

- Pobierz projekt jako pliki MIDI, WAV lub STEMS.

- Uruchom wybrany DAW (np. FL Studio, Ableton Live, Logic Pro X).

- Zaimportuj pliki do DAW, tworząc osobne ścieżki dla każdego instrumentu.

- Edytuj aranżację, zmieniaj brzmienia, dodawaj efekty i automatyzacje.

- W przypadku pluginów AIVA VST/AU – skonfiguruj plugin bezpośrednio w DAW i steruj generowaniem muzyki na żywo.

- Wykonaj miks i mastering utworu, korzystając z narzędzi DAW.

Wskazówki dla użytkowników – jak wycisnąć z AIVA maksimum?

Aby uzyskać najlepsze efekty, warto eksperymentować z różnymi stylami oraz parametrami generowania muzyki w AIVA. Praktycy polecają eksport ścieżek w formacie MIDI, co daje największą elastyczność przy dalszej produkcji. Pamiętaj, że DAW-y pozwalają na dowolne przearanżowanie wygenerowanego materiału – możesz zmieniać instrumenty, tempo czy dynamikę. Przy pracy z pluginami AIVA w DAW, zadbaj o odpowiednią moc obliczeniową komputera – generowanie muzyki w czasie rzeczywistym bywa zasobożerne. Warto też regularnie aktualizować zarówno AIVA, jak i DAW, by korzystać z nowych funkcji oraz poprawionej kompatybilności.Refleksja: Jak AI zmienia kreatywność i przyszłość muzyki?

Nowe granice kreatywności – twórczość z udziałem sztucznej inteligencji

Sztuczna inteligencja, taka jak AIVA, redefiniuje pojęcie kreatywności w muzyce. Z jednej strony daje dostęp do narzędzi pozwalających tworzyć utwory osobom bez formalnego wykształcenia muzycznego. Przykładowo, w 2026 roku ponad 30% produkcji muzyki do reklam i gier mobilnych w Europie powstaje z udziałem AI. Z drugiej strony, kompozytorzy i producenci mogą eksperymentować z formą, korzystając z wygenerowanych motywów czy struktur harmonicznych jako punktu wyjścia do własnych aranżacji. Dla twórców projektujących muzykę do filmów czy gier, AI staje się partnerem, który przyspiesza proces poszukiwania inspiracji i pozwala szybciej reagować na potrzeby rynku.Zmiana ról w branży muzycznej – wyzwania i nowe możliwości

Automatyzacja kompozycji sprawia, że rola kompozytora ewoluuje. W praktyce coraz częściej spotykamy się z funkcją "kierownika kreatywnego AI" – osoby, która nie tyle pisze nuty, co selekcjonuje, edytuje i nadaje charakter utworom wygenerowanym przez algorytmy. To otwiera nowe ścieżki kariery, ale też rodzi pytania o oryginalność i unikalność muzyki. W polskich studiach produkcyjnych, takich jak Sound Factory czy Alvernia Studios, AI wspiera już procesy pre-produkcji i generowania szkiców muzycznych, które następnie są rozwijane przez ludzi. Dla wielu firm to szansa na skrócenie cyklu produkcyjnego i obniżenie kosztów, co ma realne znaczenie w przypadku produkcji reklamowych czy seriali na żądanie.Debata społeczna i etyczna – kto kształtuje przyszłość muzyki?

Upowszechnienie AI w muzyce wywołuje dyskusje nie tylko w środowisku twórczym, ale także wśród odbiorców. W 2026 roku ponad 45% respondentów w badaniu Digital Music Poland deklaruje, że potrafi rozpoznać utwór stworzony przez AI, ale niemal połowa z nich nie widzi w tym zagrożenia dla "ludzkiej" kreatywności. Z kolei organizacje takie jak ZAiKS czy European Composer & Songwriter Alliance postulują wprowadzenie wyraźnych oznaczeń dla muzyki generowanej przez AI oraz nowych modeli wynagradzania. Przyszłość muzyki to nie tylko technologia, ale również świadome decyzje społeczne i regulacje wpływające na to, jak odbieramy i konsumujemy twórczość artystyczną.Społeczne i etyczne konsekwencje powszechnego użycia AI w muzyce

Powszechne wykorzystanie sztucznej inteligencji w muzyce budzi nie tylko ekscytację, ale i obawy – zarówno wśród twórców, jak i odbiorców. Dla kompozytorów i muzyków pojawia się realne pytanie o przyszłość ich zawodu. Według raportu IFPI z 2025 roku aż 62% profesjonalnych twórców muzyki w Europie wyraża niepokój o swoją pozycję na rynku, gdy coraz więcej utworów powstaje przy udziale narzędzi takich jak AIVA czy Google MusicLM. Producenci, wytwórnie i platformy streamingowe zyskują nowe możliwości, ale presja na szybkie dostarczanie treści może prowadzić do obniżenia jakości i zacierania granic między muzyką autentycznie twórczą a generowaną masowo.

Dla odbiorców muzyki pojawia się pytanie, czy będą potrafili odróżnić utwory stworzone przez człowieka od tych wygenerowanych przez AI. Badanie przeprowadzone w 2026 roku przez Uniwersytet Warszawski pokazało, że 48% respondentów nie rozpoznaje różnicy między kompozycjami AIVA a dziełami ludzkich kompozytorów w testach „na ślepo”. To rodzi wyzwania związane z autentycznością doświadczenia kulturowego i wpływem na rozwój gustu muzycznego nowych pokoleń.

Równie ważny jest aspekt etyczny – kto ponosi odpowiedzialność za treści generowane przez AI? W 2026 roku głośna była sprawa utworu stworzonego przez AI, w którym system nieświadomie odwzorował fragmenty znanego dzieła Chopina. Debata publiczna ogniskuje się wokół tego, czy AI może być „twórcą”, a jeśli nie, to do kogo należy odpowiedzialność za ewentualne naruszenia czy kontrowersyjne treści. Środowiska artystyczne zwracają uwagę, że powszechność AI w muzyce może prowadzić do spłycenia przekazu i utraty indywidualnego charakteru dzieł.

Jako inżynier oprogramowania i wieloletni fan muzyki, widzę tu fascynującą granicę między innowacją a poszanowaniem tradycji. Jeden z moich znajomych, zawodowy kompozytor, podsumował to trafnie: „AI daje nam niesamowite narzędzia, ale nie zastąpi duszy kompozytora, jego historii i emocji”. W 2026 roku to właśnie dialog między technologią a ludzką wrażliwością wydaje się najważniejszy – nie tylko dla branży muzycznej, ale i dla całego społeczeństwa, które konsumuje i tworzy kulturę.

Podsumowanie

AIVA otwiera nowy rozdział w tworzeniu muzyki: sztuczna inteligencja komponuje utwory, które coraz trudniej odróżnić od dzieł ludzkich artystów. W artykule pokazujemy, jak AIVA analizuje emocje i struktury muzyczne, jak wygląda workflow w połączeniu z DAW, a także jakie konsekwencje prawne i etyczne niesie za sobą ekspansja AI w branży. Dowiesz się, gdzie AIVA już dziś wspiera twórców, jak wypada w porównaniu z kompozytorami oraz co na ten temat sądzą profesjonaliści. To praktyczny przewodnik po przyszłości muzyki i kreatywności w 2026 roku!

Najczesciej zadawane pytania

Czy można używać AIVA do tworzenia muzyki w różnych gatunkach, np. jazz, rock czy muzyka elektroniczna?

Czy AIVA wymaga zaawansowanej wiedzy muzycznej lub programistycznej, aby zacząć z niej korzystać?

Jakie są koszty korzystania z AIVA i czy dostępne są darmowe wersje?

Czy muzyka wygenerowana przez AIVA może być używana w projektach komercyjnych, np. reklamach lub grach?

Jak wygląda wsparcie techniczne i rozwój platformy AIVA w 2026 roku?