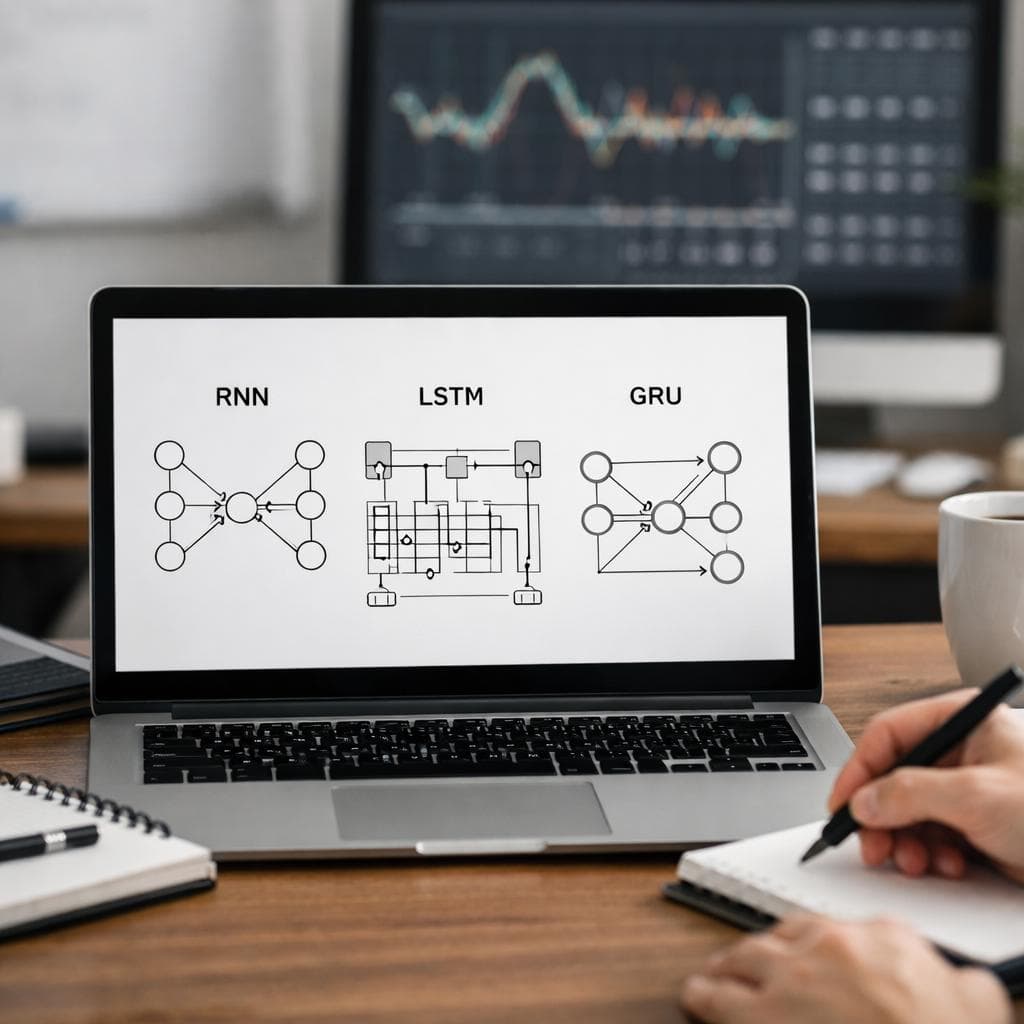

W świecie analizy sekwencji frazy RNN, LSTM i GRU przewijają się przez rozmowy nie tylko programistów, ale też liderów biznesu szukających przewagi w danych tekstowych, szeregach czasowych czy rozpoznawaniu głosu. Jakie są inspiracje biologiczne tych architektur i na czym polegają ich ograniczenia? Czym naprawdę różnią się LSTM i GRU w codziennej pracy z danymi? W tym artykule porównam wydajność, praktyczne zastosowania i mechanizmy tych sieci, pokażę, gdzie klasyczne RNN zawodzą i dlaczego nowoczesne rozwiązania – jak Transformer czy GNN – coraz częściej wypierają je z rynku. Przegląd dostępnych frameworków oraz moje spojrzenie na sens użycia tych architektur w 2026 roku dopełnią całości.

📋Na skróty

Jak działają sieci rekurencyjne (RNN): inspiracje i ograniczenia

RNN, LSTM i GRU – przegląd architektur do analizy sekwencji

Problemy klasycznych RNN: zanikanie i eksplozja gradientu w praktyce

Porównanie LSTM i GRU: wydajność, zastosowania i różnice

Nowoczesne architektury: Transformer, Capsule Networks i Graph Neural Networks

Frameworki i narzędzia do implementacji sieci neuronowych – praktyczny przegląd

Moja refleksja: kiedy RNN, LSTM lub GRU mają sens w 2026 roku?

Kluczowe wnioski

- LSTM i GRU wyraźnie przewyższają klasyczne RNN w analizie długich sekwencji – eliminują problem zanikania gradientu i są niezbędne tam, gdzie liczy się pamięć kontekstu.

- W 2026 roku Transformery oraz inne nowoczesne architektury (Capsule Networks, GNN) coraz częściej zastępują RNN w przetwarzaniu tekstu, obrazu i danych relacyjnych – zapewniają większą skalowalność i precyzję.

- Wybór między LSTM a GRU zależy od priorytetów projektu: LSTM lepiej radzi sobie z bardzo długimi sekwencjami, natomiast GRU jest szybsze w uczeniu i mniej zasobożerne.

- Najpopularniejsze frameworki do wdrożeń sieci neuronowych w 2026 roku to PyTorch, TensorFlow i Keras – oferują gotowe moduły dla różnych architektur oraz wsparcie dla automatycznego strojenia modeli.

- W praktyce biznesowej, zanim wdrożysz zaawansowane sieci, przeanalizuj realne potrzeby projektu – czasem prostsze modele sekwencyjne są wystarczające, a nowoczesne architektury warto stosować tam, gdzie liczy się skalowalność i złożoność danych.

Jak działają sieci rekurencyjne (RNN): inspiracje i ograniczenia

Sieci rekurencyjne (RNN) powstały z fascynacji tym, jak ludzki mózg radzi sobie z informacjami pojawiającymi się w czasie – na przykład rozumiejąc kontekst zdań czy analizując zmiany w szeregach czasowych. W praktyce RNN są pierwszymi architekturami, które pozwalają modelom maszynowym „zapamiętywać” fragmenty wcześniejszych danych podczas przetwarzania sekwencji. To czyni je atrakcyjnym wyborem dla firm pracujących z danymi tekstowymi, mową lub sygnałami finansowymi, gdzie kontekst i kolejność mają realne znaczenie. Warto zaznaczyć, że sieci neuronowe są szeroko wykorzystywane również w innych obszarach nowoczesnych technologii, co potęguje ich znaczenie w rozwiązywaniu różnorodnych problemów.

Z punktu widzenia biznesu, RNN otworzyły drzwi do automatycznej analizy opinii klientów, prognoz popytu czy rozpoznawania mowy w systemach IVR. Ich działanie opiera się na cyklicznym przekazywaniu informacji – wyjście z jednej chwili czasowej staje się wejściem dla kolejnej. Dzięki temu model może analizować nie tylko pojedyncze dane, ale całe sekwencje, co jest nieosiągalne dla tradycyjnych sieci typu feed-forward.

Jednak praktyczne wykorzystanie RNN szybko ujawniło ich ograniczenia. Modele te mają trudności z „pamięcią długoterminową” – gdy sekwencje są bardzo długie, istotne informacje z początku zostają zapomniane lub zniekształcone przez tzw. zanikanie i eksplozję gradientu. To oznacza, że klasyczne RNN sprawdzają się w analizie krótkich fragmentów tekstu czy sygnałów, ale zawodzą przy tłumaczeniach maszynowych lub analizie długich rozmów telefonicznych.

Wyzwania te doprowadziły do powstania nowych architektur, takich jak LSTM czy GRU, które lepiej radzą sobie z przekazywaniem informacji przez dłuższy czas. Współczesne biblioteki, takie jak TensorFlow czy PyTorch, oferują gotowe moduły do budowy RNN, jednak w praktyce coraz częściej wybiera się architektury, które minimalizują typowe problemy klasycznych sieci rekurencyjnych. Z perspektywy dewelopera i przedsiębiorcy oznacza to większą elastyczność, ale też konieczność świadomego wyboru narzędzi i rozwiązań dopasowanych do charakteru analizowanych danych.

RNN, LSTM i GRU – przegląd architektur do analizy sekwencji

- RNN (Recurrent Neural Network) – podstawowa architektura do przetwarzania sekwencji, używana m.in. w rozpoznawaniu mowy i analizie szeregów czasowych; ma ograniczoną pamięć kontekstu.

- LSTM (Long Short-Term Memory) – sieć z mechanizmem „bramek” do lepszego zapamiętywania informacji, skuteczna w analizie długich tekstów, tłumaczeniach maszynowych i prognozowaniu trendów.

- GRU (Gated Recurrent Unit) – uproszczona wersja LSTM, szybsza w uczeniu i często używana w aplikacjach mobilnych, chatbotach oraz analizie krótszych sekwencji.

Problemy klasycznych RNN: zanikanie i eksplozja gradientu w praktyce

Dlaczego zanikanie i eksplozja gradientu są wyzwaniem?

Zanikanie i eksplozja gradientu to zjawiska, które realnie ograniczają możliwości klasycznych sieci rekurencyjnych (RNN) w analizie długich sekwencji. Podczas uczenia sieci przez propagację wsteczną, wartości gradientów mogą drastycznie maleć lub rosnąć, co utrudnia efektywne dostosowywanie wag. Dla firm pracujących z danymi tekstowymi lub szeregami czasowymi, oznacza to, że klasyczne RNN często "zapominają" wcześniejsze informacje lub generują niestabilne wyniki. W kontekście nowoczesnych narzędzi wspierających analizę i automatyzację pracy z tekstem, jak Notion AI, rośnie zapotrzebowanie na stabilne i skuteczne modele sekwencyjne. Problem jest szczególnie widoczny w zastosowaniach takich jak analiza sentymentu w długich recenzjach, prognozowanie trendów finansowych czy rozpoznawanie mowy na poziomie całych zdań.Jak objawia się zanikanie i eksplozja gradientu?

W praktyce zanikanie gradientu powoduje, że sieć przestaje się uczyć zależności między odległymi elementami sekwencji. Przykładowo, RNN analizujący tekst może zignorować kluczowe słowa na początku zdania. Eksplozja gradientu prowadzi natomiast do niestabilności uczenia – wartości wag mogą gwałtownie rosnąć, co często kończy się "nauką na pamięć" (overfitting) lub błędami numerycznymi. W środowisku biznesowym skutkuje to modelami, które albo nie generalizują, albo są nieprzewidywalne w produkcji.- Sieci RNN mają trudności z przetwarzaniem sekwencji dłuższych niż 20-30 kroków czasowych.

- Model może ignorować kluczowe informacje, jeśli znajdują się zbyt daleko od bieżącego kroku.

- Uczenie staje się bardzo powolne lub zatrzymuje się, gdy gradienty zanikają.

- Eksplozja gradientu może prowadzić do skokowych zmian wag, co destabilizuje model.

- W praktyce wymaga to częstego restartowania procesu uczenia lub stosowania sztucznych ograniczeń (np. obcinania gradientów – gradient clipping).

Jak radzić sobie z tymi problemami – narzędzia i rozwiązania

W 2026 roku, programiści korzystają z rozwiązań takich jak LSTM i GRU, które dzięki specjalnym mechanizmom bramek pozwalają na efektywne uczenie się zależności w długich sekwencjach. Popularne frameworki jak TensorFlow (2.x), PyTorch (od wersji 2.0) czy Keras oferują gotowe implementacje tych architektur oraz narzędzia do monitorowania gradientów podczas treningu. W praktyce stosuje się też techniki takie jak normalizacja warstw (Layer Normalization), obcinanie gradientów czy automatyczny dobór architektury (AutoML), by minimalizować skutki omawianych problemów. Dla zespołów biznesowych oznacza to większą pewność działania modeli i lepsze wykorzystanie potencjału danych sekwencyjnych.Porównanie LSTM i GRU: wydajność, zastosowania i różnice

Dla kogo ma znaczenie wybór między LSTM a GRU?

Wybór między LSTM a GRU to realny dylemat dla zespołów wdrażających rozwiązania oparte na przetwarzaniu sekwencji – zarówno w startupach, jak i w dużych firmach, gdzie liczą się koszty infrastruktury, czas uczenia oraz efektywność modeli. Przykładowo, fintechy analizujące sekwencje transakcji, firmy e-commerce prognozujące popyt czy zespoły R&D pracujące nad rozpoznawaniem mowy muszą zdecydować, czy postawić na większą precyzję, czy na szybkość i mniejsze zużycie zasobów. To także temat istotny dla osób rozwijających rozwiązania na urządzenia mobilne i edge computing, gdzie liczy się każdy megabajt pamięci i każda sekunda czasu obliczeń.Różnice architektoniczne i wpływ na wydajność

LSTM i GRU wywodzą się z tej samej idei – radzenia sobie z długimi zależnościami w danych sekwencyjnych – ale ich architektury znacząco się różnią. LSTM posiada trzy bramki (zapominania, wejścia, wyjścia) i osobny stan komórkowy, co sprawia, że lepiej utrzymuje informacje na długich odcinkach, ale kosztem większej liczby parametrów. GRU upraszcza ten schemat: wykorzystuje dwie bramki (resetującą i aktualizującą) oraz łączy stan komórkowy ze stanem ukrytym. W praktyce GRU szybciej się trenuje i zużywa mniej pamięci, co potwierdzają benchmarki na zbiorach takich jak IMDB (analiza sentymentu) czy TIMIT (rozpoznawanie mowy) – GRU osiąga podobną dokładność przy krótszym czasie uczenia (nawet o 20-30% szybciej w PyTorch czy TensorFlow). W aplikacjach wymagających bardzo długiego "pamiętania" (np. generowanie tekstu, tłumaczenia maszynowe) LSTM potrafi dać przewagę, ale różnice często zacierają się przy odpowiedniej regularyzacji i optymalizacji.Praktyczne zastosowania i narzędzia

W 2026 roku oba typy sieci są szeroko wspierane przez narzędzia takie jak TensorFlow, PyTorch czy Keras, co pozwala łatwo eksperymentować z architekturą. LSTM dominuje w zadaniach wymagających głębokiego modelowania kontekstu, np. w systemach tłumaczeń (Google Translate korzystał z LSTM zanim przeszedł na architekturę Transformer) czy generowaniu muzyki. GRU jest często wybierany w aplikacjach mobilnych, chatbotach czy systemach analizy sygnałów, gdzie liczy się szybkość i oszczędność zasobów. W polskich realiach – np. w projektach z zakresu prognozowania sprzedaży czy klasyfikacji wiadomości – GRU sprawdza się jako kompromis między jakością a wydajnością.| Cecha | LSTM | GRU |

|---|---|---|

| Architektura | 3 bramki, oddzielny stan komórkowy | 2 bramki, połączony stan |

| Wydajność uczenia | Wolniejsza, więcej parametrów | Szybsza, mniej parametrów |

| Zużycie zasobów | Większe (RAM, CPU/GPU) | Mniejsze |

| Łatwość implementacji | Więcej hiperparametrów | Bardziej kompaktowa |

| Typowe zastosowania | Tłumaczenia, generowanie tekstu | Chatboty, prognozowanie szeregów |

Nowoczesne architektury: Transformer, Capsule Networks i Graph Neural Networks

Przez ostatnie lata architektury sieci neuronowych przeszły rewolucję – od rozwiązań typowo sekwencyjnych do modeli, które potrafią analizować ogromne zbiory danych, relacje przestrzenne i złożone struktury. To nie jest tylko ciekawostka dla naukowców – dla firm, które chcą przetwarzać język naturalny, obrazy czy dane grafowe, wybór odpowiedniej architektury przekłada się na realne przewagi biznesowe. W 2026 r. coraz więcej startupów i korporacji w Polsce wdraża modele Transformer i GNN do automatyzacji obsługi klienta, personalizacji ofert czy analizy sieci społecznościowych.

Każda z tych nowoczesnych architektur rozwiązuje inne wyzwania. Transformer zdeklasował RNN-y w przetwarzaniu tekstu i mowy, bo zamiast przetwarzać dane sekwencyjnie, pozwala analizować cały kontekst naraz dzięki mechanizmowi self-attention. Capsule Networks lepiej oddają relacje przestrzenne w obrazach, co przydaje się w rozpoznawaniu obiektów w trudnych warunkach, na przykład w branży automotive. Z kolei Graph Neural Networks umożliwiają analizę danych o powiązaniach – idealne do wykrywania nadużyć w finansach czy rekomendacji produktów na podstawie sieci powiązań użytkowników.

- Transformer: Błyskawicznie analizuje długie sekwencje, rewelacyjny w NLP, tłumaczeniach, generowaniu tekstu (np. ChatGPT, Google BERT).

- Capsule Networks: Odporne na zniekształcenia obrazu, lepiej rozpoznają części i relacje w zdjęciach, wykorzystywane w medycynie i motoryzacji.

- Graph Neural Networks (GNN): Analizują dane w formie grafów, stosowane w wykrywaniu fraudów, analizie sieci społecznościowych i biologicznych.

Transformery to dziś fundament takich narzędzi jak PyTorch czy TensorFlow – wdrożenie modelu tekstowego z biblioteką Hugging Face zajmuje zespołowi dni, nie miesiące. Z punktu widzenia programisty, przejście od klasycznego RNN do GNN czy Capsule Networks wymaga innego podejścia do danych, ale daje dostęp do nowych możliwości. Często powtarzam swoim klientom: „Nie kopiuj rozwiązań z Google, gdy masz dane grafowe jak Allegro czy OLX – lepiej sięgnij po GNN i wyciągnij prawdziwe wnioski z relacji między użytkownikami.”

To nie są już technologie eksperymentalne – w 2026 r. polskie firmy wdrażają GNN do analizy powiązań biznesowych, a Capsule Networks pomagają w diagnostyce obrazowej w szpitalach. Wybierając architekturę, patrzmy nie tylko na trendy, ale przede wszystkim na charakter danych i cel biznesowy. Nowoczesne sieci neuronowe otwierają nowe ścieżki rozwoju – zarówno dla zespołów IT, jak i całych organizacji.

Frameworki i narzędzia do implementacji sieci neuronowych – praktyczny przegląd

Dlaczego wybór frameworka ma znaczenie w biznesie i R&D?

Wdrażanie sieci neuronowych, takich jak RNN, LSTM czy GRU, wymaga nie tylko wiedzy algorytmicznej, ale też sprawnych narzędzi. Wybór frameworka wpływa bezpośrednio na szybkość prototypowania, łatwość wdrożenia i koszty utrzymania projektu. Firmy, które rozwijają własne produkty AI, docenią elastyczność PyTorch lub bogaty ekosystem TensorFlow, podczas gdy zespoły marketingowe czy startupy często stawiają na prostotę Keras. Dla programistów istotne jest wsparcie społeczności, dokumentacja oraz dostępność gotowych rozwiązań pod konkretne zadania – od analizy tekstu po przetwarzanie sygnałów.Najpopularniejsze frameworki: czym się różnią?

TensorFlow, PyTorch i Keras to obecnie najczęściej wybierane platformy do budowy sieci neuronowych. TensorFlow, rozwijany przez Google, pozwala na skalowanie od eksperymentów do wdrożeń produkcyjnych – obsługuje zarówno modele sekwencyjne, jak i nowoczesne architektury (np. Transformer). PyTorch, preferowany w środowisku naukowym, oferuje dynamiczne grafy obliczeniowe i prostotę debugowania, co przyspiesza eksperymenty z nowymi architekturami. Keras działa jako warstwa wysokiego poziomu nad TensorFlow, umożliwiając szybkie budowanie modeli bez konieczności zagłębiania się w szczegóły implementacyjne. Każdy z tych frameworków posiada zaawansowane narzędzia do wizualizacji, trenowania i eksportowania modeli do środowisk produkcyjnych.Tabela porównawcza: TensorFlow, PyTorch, Keras

| Framework | Wsparcie dla RNN/LSTM/GRU | Wsparcie dla Transformer | Łatwość użycia | Popularność w biznesie |

|---|---|---|---|---|

| TensorFlow | Pełne (moduły tf.keras.layers) | Bardzo dobre (TF Hub, TFX) | Średnia (krzywa uczenia się) | Wysoka |

| PyTorch | Pełne (torch.nn) | Świetne (transformers od HuggingFace) | Wysoka (intuicyjny kod) | Średnia/Wysoka |

| Keras | Pełne (warstwa nad TensorFlow) | Dobre (przez TensorFlow) | Bardzo wysoka (przystępne API) | Średnia |

Moja refleksja: kiedy RNN, LSTM lub GRU mają sens w 2026 roku?

W 2026 roku wybór architektury sieci sekwencyjnych to już nie tylko kwestia mody technologicznej, ale przede wszystkim opłacalności i specyfiki projektu. RNN, LSTM i GRU są coraz rzadziej pierwszym wyborem w komercyjnych wdrożeniach NLP czy rozpoznawania mowy, bo w wielu zadaniach zostały wyparte przez modele typu Transformer (np. BERT, GPT-4, Gemini). Jednak ich miejsce nie zniknęło całkowicie – wciąż mają zastosowanie tam, gdzie liczy się szybkość działania, ograniczone zasoby sprzętowe lub prostota implementacji.

Z perspektywy firmy, która rozwija systemy embedded, analizuje dane z sensorów IoT czy pracuje na krótkich sekwencjach czasowych – LSTM i GRU bywają bardziej praktyczne niż rozbudowane modele atencyjne. Przykładowo, do rozpoznawania prostych wzorców w danych finansowych czy predykcji awarii maszyn w czasie rzeczywistym, nieduże sieci GRU uruchomione na Raspberry Pi lub ESP32 są po prostu bardziej efektywne energetycznie i mniej kosztowne w utrzymaniu niż duże modele Transformerowe.

W środowiskach akademickich i R&D, RNN oraz ich warianty wciąż pełnią rolę narzędzi do testowania nowych pomysłów, bo są łatwe do zrozumienia, szybkie w prototypowaniu (np. w PyTorch czy TensorFlow) i pozwalają skupić się na eksperymentach z architekturą. W edukacji LSTM i GRU to wciąż podstawowy materiał – bez ich zrozumienia trudno później sensownie korzystać z nowoczesnych rozwiązań.

Nie można też pominąć aspektu kosztów wdrożenia i utrzymania. W mniejszych firmach, gdzie budżet na infrastrukturę chmurową jest ograniczony, wdrożenie lekkiej sieci GRU do klasyfikacji tekstów czy analizy logów daje realną przewagę nad kosztownymi modelami wielkoskalowymi. Oprogramowanie open source, takie jak Keras czy scikit-learn, pozwala wdrożyć takie modele bez zbędnych komplikacji i wysokich kosztów licencyjnych.

Mówiąc wprost – RNN, LSTM i GRU to dziś narzędzia do zadań specjalnych, gdzie liczy się kompromis między jakością predykcji, zużyciem zasobów a czasem wdrożenia. Warto po nie sięgać tam, gdzie Transformer jest przesadą, a prostota i przewidywalność działania mają większą wartość niż absolutny top accuracy w benchmarkach.

Podsumowanie

Artykuł to praktyczny przewodnik po architekturach sieci neuronowych do analizy sekwencji: od klasycznych RNN, przez LSTM i GRU, aż po nowoczesne Transformery i Graph Neural Networks. Pokazuje, jak konkretne ograniczenia (np. zanikanie gradientu) wpływają na wybór technologii w realnych projektach. Znajdziesz tu jasne porównania wydajności, przykłady zastosowań i przegląd najważniejszych narzędzi – wszystko z perspektywy biznesu i programisty. Jeśli szukasz aktualnych odpowiedzi, kiedy warto postawić na RNN, LSTM lub GRU w 2026 roku, ten tekst rozwiewa wątpliwości i inspiruje do świadomego wyboru architektury.

Najczesciej zadawane pytania

Jakie są typowe błędy popełniane podczas wdrażania RNN, LSTM lub GRU w projektach biznesowych?

Czy RNN, LSTM i GRU wymagają dużych zasobów obliczeniowych?

Jakie są alternatywy dla RNN, LSTM i GRU, jeśli zależy mi na szybkości działania modelu?

Czy można łączyć różne typy sieci neuronowych w jednym projekcie?

Jak ocenić, czy mój model sekwencyjny działa poprawnie w zastosowaniach biznesowych?