Natural language processing, czyli przetwarzanie języka naturalnego (NLP), to dziś serce rewolucji w komunikacji między ludźmi a maszynami. Rozumienie tekstu, generowanie odpowiedzi, analizowanie emocji – NLP robi to coraz sprawniej, a w 2026 roku sięga po technologie, które jeszcze kilka lat temu wydawały się science fiction. W tym artykule pokażę, jak NLP rozwinęło się w ostatnich latach, jakie metody i narzędzia napędzają nowoczesne rozwiązania, gdzie NLP przynosi realne korzyści w biznesie, z czym mierzą się specjaliści, a także jak wygląda przyszłość tej dziedziny w polskich firmach. Przed nami praktyczne przykłady, porównania narzędzi i spojrzenie na wyzwania etyczne w świecie NLP.

📋Na skróty

Czym jest natural language processing? Definicja i rozwój NLP w 2026 roku

Najważniejsze podejścia w NLP: od reguł po modele językowe XXI wieku

Typowe zadania i zastosowania NLP w biznesie – praktyczne przykłady

Największe wyzwania i ograniczenia przetwarzania języka naturalnego

NLP w praktyce: porównanie popularnych bibliotek i narzędzi w 2026 roku

Najważniejsze trendy w NLP – modele LLM, prompt engineering i przyszłość branży

Odpowiedzialne wykorzystanie NLP: etyka, prywatność i sprawiedliwość algorytmiczna

Moja refleksja: Przyszłość NLP w polskich firmach – szanse i zagrożenia

Kluczowe wnioski

- Natural language processing stało się fundamentem nowoczesnych rozwiązań biznesowych, umożliwiając automatyzację obsługi klienta, analizę opinii czy inteligentne wyszukiwanie informacji.

- W 2026 roku dominują modele oparte na deep learning i LLM, które skutecznie radzą sobie z rozumieniem i generowaniem polskiego języka – jednak wymagają dużych zasobów i odpowiedzialnego wdrożenia.

- Wybór narzędzi NLP, takich jak spaCy, Hugging Face Transformers czy polskie modele open-source, powinien być podyktowany konkretnymi potrzebami biznesowymi i dostępnością zespołu technicznego.

- Największe wyzwania to wieloznaczność języka, kontekst kulturowy oraz ryzyko błędów – dlatego testowanie i regularna walidacja modeli są niezbędne w każdym projekcie NLP.

- Odpowiedzialne wdrożenie NLP wymaga dbałości o prywatność danych, transparentność algorytmów i eliminowanie uprzedzeń, co buduje zaufanie klientów i partnerów biznesowych.

Czym jest natural language processing? Definicja i rozwój NLP w 2026 roku

Natural language processing: od teorii do praktyki

Niewiele technologii przekształciło sposób, w jaki firmy i użytkownicy końcowi korzystają z informacji, tak jak natural language processing. NLP to dziedzina łącząca lingwistykę komputerową, uczenie maszynowe oraz analizę danych, która pozwala maszynom rozumieć, interpretować i generować tekst oraz mowę w języku naturalnym. Kluczową rolę odgrywają tu różnorodne architektury sieci neuronowych, umożliwiające analizę i przetwarzanie danych sekwencyjnych, czyli tekstów i wypowiedzi. W 2026 roku NLP to nie tylko rozpoznawanie komend głosowych – to podstawa asystentów AI, systemów obsługi klienta, automatycznej analizy dokumentów czy narzędzi dla e-commerce. Przetwarzanie języka naturalnego stało się kluczowe dla firm, które chcą lepiej komunikować się z klientami, analizować dane tekstowe i automatyzować procesy wymagające rozumienia języka. Przykłady? W polskich bankach NLP analizuje rozmowy z infolinii, a w e-sklepach podpowiada klientom produkty na bazie ich pytań.Znaczenie NLP dla biznesu i użytkowników

Wartość rynku narzędzi NLP przekroczyła globalnie 55 mld USD w 2025 roku i nadal rośnie w tempie ponad 20% rocznie. Firmy inwestują w NLP, by zwiększyć efektywność obsługi klienta, wyłapywać trendy w opiniach użytkowników czy przyspieszyć przetwarzanie dokumentów. Z punktu widzenia użytkownika oznacza to lepsze wyszukiwarki, bardziej trafne rekomendacje czy dostęp do spersonalizowanych asystentów głosowych. Dla startupów NLP otwiera drogę do tworzenia innowacyjnych usług – od automatycznego tłumaczenia po monitoring nastrojów konsumentów. Na polskim rynku rozwiązania takie jak Google Cloud Natural Language, Microsoft Azure Text Analytics czy polskie startupy wykorzystujące modele językowe (np. VoiceLab, SentiOne) już dziś wspierają setki firm.Jak NLP zmienia codzienność w 2026 roku?

W 2026 roku NLP nie jest już domeną wielkich korporacji. Narzędzia takie jak Hugging Face Transformers, spaCy czy ChatGPT API umożliwiają nawet małym zespołom wdrażanie zaawansowanych analiz tekstu i automatyzacji dialogów. Przetwarzanie języka naturalnego napędza systemy do automatycznego podsumowywania raportów, analizy sentymentu, rozpoznawania mowy i generowania treści. Przykładowo, firmy HR wykorzystują NLP do analizy CV, a branża medyczna – do automatycznego kodowania dokumentacji pacjentów. Dla wielu sektorów realną zmianą jest dostępność gotowych modeli językowych (np. GPT-4, BERT, T5), które można łatwo dostosować do własnych danych bez konieczności budowania wszystkiego od zera.Najważniejsze podejścia w NLP: od reguł po modele językowe XXI wieku

Od reguł do uczenia maszynowego – jak zmieniało się NLP

W przetwarzaniu języka naturalnego zmiany technologiczne wyznaczają kolejne etapy rozwoju – od prostych systemów regułowych, po zaawansowane modele językowe. Początkowo NLP opierało się na ręcznie tworzonych regułach gramatycznych i słownikach. Takie podejście sprawdzało się w ograniczonych zastosowaniach, np. rozpoznawaniu słów kluczowych w wyszukiwarkach lub prostych systemach eksperckich. Przełom nastąpił wraz z pojawieniem się uczenia maszynowego, gdzie modele statystyczne (np. modele n-gramowe) zaczęły wykorzystywać duże zbiory danych tekstowych do prognozowania kolejnych słów czy klasyfikowania dokumentów. Dla firm przejście od reguł do modeli uczenia maszynowego oznaczało większą elastyczność i możliwość automatyzacji analizy dużych wolumenów tekstu bez ręcznego kodowania każdej reguły. Z kolei wraz z rozwojem narzędzi takich jak Originality.AI, pojawiła się potrzeba nie tylko generowania, ale również skutecznej weryfikacji oryginalności treści przetwarzanych przez nowoczesne modele NLP.- Regułowe podejście – oparte na ręcznie tworzonych zasadach gramatycznych i słownikach.

- Statystyczne modele – wykorzystują prawdopodobieństwo i duże zbiory danych, np. modele n-gramowe, Hidden Markov Models.

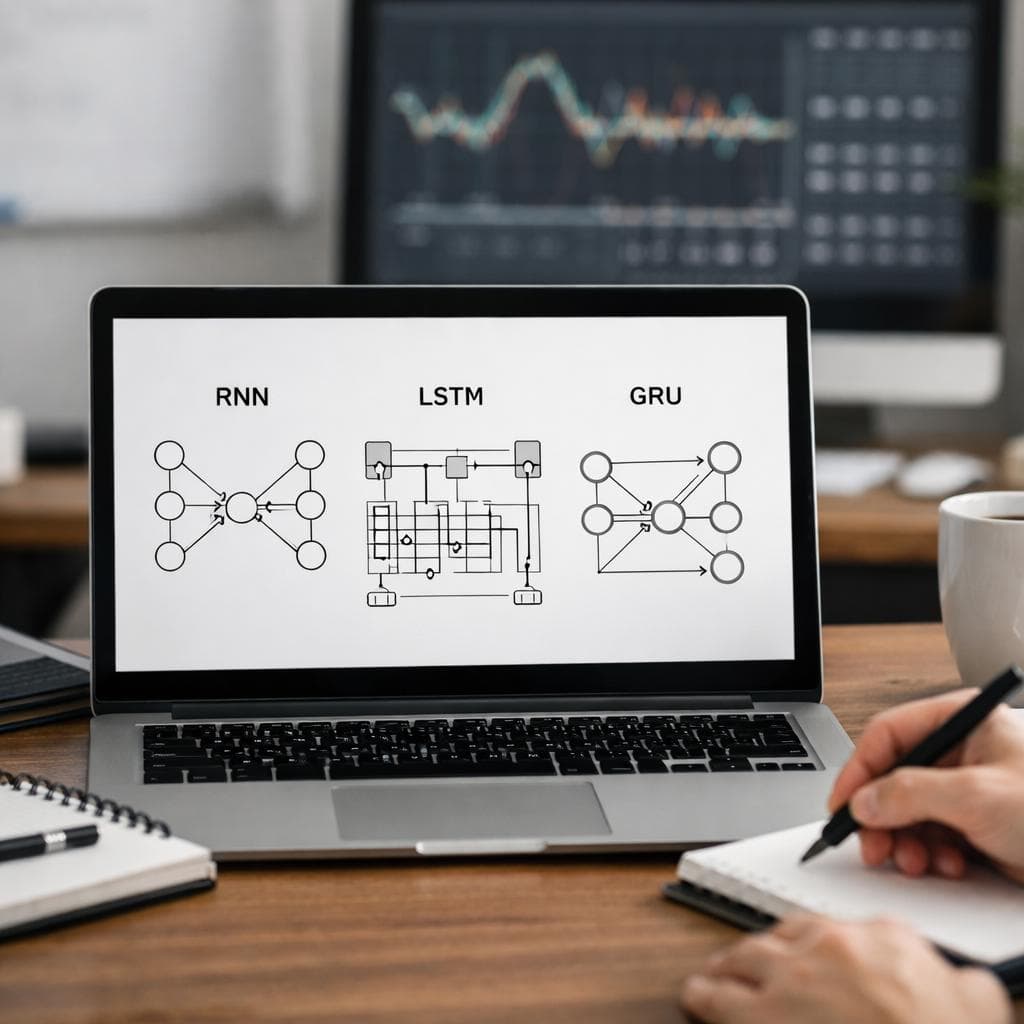

- Deep learning – sieci neuronowe, np. LSTM, GRU, pozwalają na rozpoznawanie kontekstu i zależności w tekście.

- Modele transformerowe – architektury jak BERT, GPT, T5, które rozumieją kontekst całych zdań i dokumentów.

- Foundation models – duże modele językowe (LLM), jak GPT-4, Llama 3, służące do szerokiego zakresu zadań NLP.

Deep learning i transformery: nowe możliwości rozumienia języka

Sieci neuronowe typu LSTM czy GRU przyniosły przełom w analizie sekwencyjnej tekstu, poprawiając jakość tłumaczenia maszynowego i rozpoznawania intencji w chatbotach. Przykładowo, polskie firmy e-commerce wykorzystują modele deep learning do analizy opinii klientów, wykrywając pozytywne i negatywne wzorce językowe. Wejście na rynek architektur transformerowych (BERT, GPT, T5) umożliwiło modelom uwzględnianie kontekstu całych fragmentów tekstu, co przełożyło się na lepsze wyniki w zadaniach takich jak ekstrakcja informacji czy generowanie podsumowań. W 2026 roku coraz więcej rozwiązań biznesowych korzysta z foundation models, które dzięki skalowaniu (setki miliardów parametrów) radzą sobie z rozumieniem niuansów językowych i adaptacją do różnych branż, od finansów po medycynę.Dla kogo i kiedy wybrać konkretne podejście?

Wybór technologii zależy od potrzeb organizacji i zasobów. Systemy regułowe sprawdzają się przy prostych zadaniach lub gdy wymagane jest pełne wyjaśnienie działania algorytmu – np. w aplikacjach prawnych czy finansowych. Modele statystyczne i deep learningowe są skuteczne tam, gdzie kluczowa jest automatyzacja dużych wolumenów tekstu, np. w analizie sentymentu czy klasyfikacji dokumentów. Najnowsze foundation models, jak GPT-4 czy Gemini, wybierają firmy, które potrzebują uniwersalnych rozwiązań: asystentów głosowych, automatycznych podsumowań czy wielojęzycznych chatbotów. W praktyce wdrożenie zaawansowanych modeli wymaga solidnej infrastruktury IT, dostępu do dużych zbiorów danych i kompetencji w zakresie zarządzania AI.Typowe zadania i zastosowania NLP w biznesie – praktyczne przykłady

Dla kogo NLP ma największe znaczenie w 2026 roku?

Przetwarzanie języka naturalnego zmieniło sposób działania wielu branż w Polsce – od bankowości przez e-commerce po sektor publiczny. Właściciele firm, startupy i osoby decyzyjne coraz częściej sięgają po NLP, by zautomatyzować obsługę klienta, poprawić personalizację ofert czy przyspieszyć analizę dokumentów. Programiści, marketerzy i analitycy wykorzystują gotowe modele językowe oraz narzędzia takie jak Hugging Face Transformers, spaCy czy Google AutoML. Przykładem narzędzia, które łączy NLP z praktycznymi zastosowaniami w codziennej pracy biurowej, jest Notion AI, umożliwiające automatyzację tworzenia notatek i zarządzania zadaniami. W 2026 roku dostępność narzędzi open source i API sprawia, że nawet mniejsze firmy mogą wdrażać zaawansowane rozwiązania NLP bez dużych inwestycji w infrastrukturę IT.

Najpopularniejsze zadania NLP i ich zastosowanie biznesowe

- Analiza sentymentu – identyfikacja emocji w opiniach klientów, wykorzystywana w monitoringu mediów społecznościowych i ocenie reputacji marki.

- Rozpoznawanie nazw własnych (NER) – automatyczne wykrywanie nazw firm, produktów czy lokalizacji w umowach i wiadomościach e-mail.

- Chatboty i voiceboty – wsparcie obsługi klienta przez automatyczne prowadzenie konwersacji w języku naturalnym, np. w bankowości lub e-commerce.

- Automatyczne tłumaczenie tekstów – szybkie przekładanie treści na wiele języków, co przyspiesza ekspansję na nowe rynki i obsługę zagranicznych klientów.

- Generacja tekstu – tworzenie automatycznych podsumowań raportów, generowanie ofert handlowych czy personalizowanych rekomendacji produktowych.

- Kategoryzacja i klasyfikacja dokumentów – segregowanie korespondencji, faktur i zapytań według tematyki lub priorytetu.

- Ekstrakcja informacji – wydobywanie kluczowych danych z aktów prawnych, umów czy dokumentacji medycznej bez ręcznego przeglądania treści.

Jak NLP działa w praktyce: przykłady wdrożeń i efekty

W polskim e-commerce wdrożenie analizy sentymentu pozwala na codzienną analizę tysięcy opinii klientów, umożliwiając szybką reakcję na negatywne komentarze. Banki wykorzystują rozpoznawanie nazw własnych do automatycznego wyłapywania danych w dokumentach kredytowych. Firmy logistyczne stosują automatyczne tłumaczenie oraz generację tekstu do obsługi międzynarodowych zamówień. W 2026 roku chatboty oparte na dużych modelach językowych (np. GPT-4, Llama 3) obsługują już ponad 60% zapytań klientów bez udziału człowieka, co znacząco obniża koszty operacyjne i skraca czas odpowiedzi. Dla startupów popularne są narzędzia SaaS oferujące gotowe API do większości zadań NLP, co pozwala szybko testować i wdrażać nowe usługi bez konieczności budowania własnych modeli od zera.

Największe wyzwania i ograniczenia przetwarzania języka naturalnego

Przetwarzanie języka naturalnego w 2026 roku mierzy się z wyzwaniami, które bezpośrednio wpływają na jakość i bezpieczeństwo wdrożeń biznesowych. Wieloznaczność polszczyzny, kontekst kulturowy czy slang internetowy sprawiają, że nawet najlepsze modele – takie jak GPT-4 czy BERT – nie zawsze właściwie interpretują intencje użytkownika. To szczególnie istotne w branżach regulowanych, gdzie błędna interpretacja może prowadzić do kosztownych pomyłek lub naruszenia przepisów.

- Wieloznaczność języka – Słowa i frazy mają wiele znaczeń zależnych od kontekstu, co utrudnia precyzyjną analizę tekstu.

- Błędy modelowania – Modele NLP, nawet te o miliardach parametrów, mogą generować niepoprawne lub nieadekwatne odpowiedzi, szczególnie gdy brakuje im danych domenowych.

- Uprzedzenia algorytmów – Modele językowe przejmują bias z danych treningowych, co prowadzi do powielania stereotypów lub dyskryminujących treści.

- Problemy z danymi – Dostępność dużych, wysokiej jakości zbiorów tekstowych w języku polskim jest ograniczona, co wpływa na skuteczność narzędzi takich jak spaCy czy Hugging Face Transformers.

- AI-complete – Pełne rozumienie języka przez maszynę wymaga ludzkiego poziomu inteligencji i wiedzy o świecie, co wciąż pozostaje poza zasięgiem obecnych technologii.

W praktyce firmy wdrażające NLP napotykają też na bariery związane z ochroną prywatności i zgodnością z RODO. Automatyzacja obsługi klienta czy analiza opinii w social mediach wymaga nie tylko wysokiej precyzji, ale także kontroli nad tym, jakie dane trafiają do modeli. Dodatkowo, szybki rozwój języka (nowe memy, skróty, zmieniające się trendy) sprawia, że systemy NLP muszą być regularnie aktualizowane i trenowane na świeżych danych. To generuje realne koszty oraz wymaga stałego zaangażowania zespołów IT i analityków danych.

NLP w praktyce: porównanie popularnych bibliotek i narzędzi w 2026 roku

Dla osób wdrażających natural language processing w biznesie wybór odpowiedniego narzędzia to decyzja, która realnie wpływa na koszty, czas wdrożenia i jakość rozwiązań. W 2026 roku rynek bibliotek NLP oferuje szeroki wachlarz możliwości – od lekkich modułów analitycznych po rozbudowane frameworki wspierające modele językowe z setkami miliardów parametrów. Właścicielom firm zależy na szybkim prototypowaniu i integracji z systemami, programistom na elastyczności i dokumentacji, a analitykom – na łatwym dostępie do gotowych pipeline’ów przetwarzania tekstu.

W codziennej pracy najczęściej pojawiają się pięć nazw: spaCy, NLTK, Hugging Face Transformers, AllenNLP oraz Stanza. Każda z nich odpowiada na inne potrzeby – spaCy ceniona jest w polskich firmach za wydajność i wsparcie języka polskiego, NLTK służy najczęściej do nauki i prostych analiz, Hugging Face pozwala korzystać z najnowszych modeli generatywnych, a AllenNLP i Stanza sprawdzają się w zadaniach wymagających precyzyjnego rozkładu składniowego i analizy morfosyntaktycznej. Gdy rozmawiam z zespołami projektowymi, często słyszę: "Wybraliśmy spaCy, bo świetnie radzi sobie z polskimi tekstami i nie wymaga ogromnej mocy obliczeniowej" – to podejście typowe dla firm szukających równowagi między jakością a efektywnością.

Poniżej zestawiam najważniejsze cechy wybranych bibliotek NLP w 2026 roku:

| Narzędzie | Funkcjonalności | Wsparcie języków | Popularność (GitHub) | Wsparcie społeczności |

|---|---|---|---|---|

| spaCy | Ekstrakcja, NER, lematyzacja, wsparcie polskiego | 30+ (w tym PL) | 39k+ ★ | Bardzo aktywna |

| NLTK | Tokenizacja, analiza składniowa, klasyfikacja | Angielski, podstawowe wsparcie innych | 12k+ ★ | Duża, gł. akademicka |

| Hugging Face Transformers | Modele generatywne, LLM, transfer learning | 100+ (w tym PL) | 120k+ ★ | Największa, globalna |

| AllenNLP | Analiza semantyczna, rozkład składniowy | Gł. angielski | 12k+ ★ | Średnia, naukowa |

| Stanza | Analiza morfosyntaktyczna, NER | 70+ (w tym PL) | 8k+ ★ | Aktywna, wsparcie Stanford |

W 2026 roku coraz częściej spotykam się z hybrydowym podejściem – firmy łączą spaCy do ekstrakcji informacji z lokalnych dokumentów z Hugging Face do generowania podsumowań lub automatycznego tłumaczenia. Taka elastyczność pozwala osiągnąć wysoką jakość bez konieczności inwestowania w budowę własnych modeli od zera. Z mojego doświadczenia wynika, że decyzja o wyborze narzędzia powinna zawsze wynikać z jasno określonych potrzeb projektu – czasem szybkie wdrożenie wygrywa z najnowszą technologią. Jak powiedział mi ostatnio CTO jednego z fintechów: "Dla nas liczy się nie tylko AI na papierze, ale to, jak szybko możemy wdrożyć realne rozwiązanie".

Najważniejsze trendy w NLP – modele LLM, prompt engineering i przyszłość branży

Natural language processing w 2026 roku to nie tylko rozpoznawanie tekstu czy analiza sentymentu. Największą zmianę przyniosły modele typu LLM (large language models), takie jak GPT-4, Gemini 1.5 czy polski Heron, które potrafią generować tekst, tłumaczyć, streszczać i analizować dane na poziomie przewyższającym wcześniejsze generacje. Skalowalność i możliwość dostosowania tych modeli do specyficznych potrzeb biznesowych sprawiają, że korzystają z nich zarówno startupy, jak i duże korporacje – od banków po sektor medyczny. Dla firm liczy się nie tylko automatyzacja obsługi klienta, ale też przyspieszenie analizy dokumentów, optymalizacja procesów HR czy dynamiczne generowanie treści marketingowych.

W 2026 roku prompt engineering stał się osobnym zawodem. Tworzenie skutecznych zapytań do modeli językowych wymaga nie tylko znajomości języka, ale też zrozumienia architektury i ograniczeń LLM. Przykładowo, dobrze zaprojektowany prompt pozwala uzyskać precyzyjne odpowiedzi w analizie kontraktów prawnych czy generowaniu raportów finansowych. To przesuwa kompetencje z typowego kodowania na projektowanie interakcji z AI – umiejętność, która jest coraz bardziej poszukiwana na rynku pracy, zwłaszcza w branżach regulowanych i w pracy z danymi wrażliwymi.

Nowym wyzwaniem dla branży NLP jest personalizacja modeli oraz ochrona prywatności. Firmy coraz częściej trenują modele na własnych danych (fine-tuning), wykorzystując platformy takie jak Hugging Face czy OpenAI Custom Models. To umożliwia tworzenie rozwiązań dostosowanych do branży: chatboty dla e-commerce rozumiejące polskie idiomy, narzędzia do analizy akt sądowych czy systemy medyczne wspierające lekarzy w analizie opisów badań. Równolegle rośnie nacisk na transparentność i audytowalność modeli – użytkownicy i regulatorzy oczekują wyjaśnialności algorytmów oraz kontroli nad danymi wejściowymi i wyjściowymi.

Przyszłość NLP rysuje się wokół multimodalności – integracji tekstu, obrazu i dźwięku w jednym modelu. Rozwiązania takie jak Gemini czy LLaVA pozwalają już dziś analizować dokumenty z grafiką, rozumieć kontekst rozmów głosowych czy generować dynamiczne podsumowania wideo. To otwiera nowe możliwości w edukacji, marketingu i obsłudze klienta. Dla firm oznacza to szansę na budowę zupełnie nowych produktów cyfrowych, które lepiej rozumieją użytkownika i kontekst jego działań.

Odpowiedzialne wykorzystanie NLP: etyka, prywatność i sprawiedliwość algorytmiczna

Natural language processing w 2026 roku to nie tylko technologia – to realny wpływ na życie ludzi i funkcjonowanie firm. Wdrażając systemy oparte na NLP, przedsiębiorstwa muszą brać pod uwagę kwestie etyczne, bezpieczeństwo danych oraz sprawiedliwość algorytmiczną. Problem nie dotyczy wyłącznie gigantów technologicznych – nawet małe firmy, korzystające z gotowych narzędzi, jak Google Cloud Natural Language czy OpenAI API, mają obowiązek ochrony prywatności użytkowników i przestrzegania norm prawnych, takich jak RODO czy DSA. Zaniedbanie tych aspektów może prowadzić do wycieków danych, strat finansowych czy utraty zaufania klientów.

Jednym z największych wyzwań jest transparentność działania modeli językowych. Algorytmy NLP, zwłaszcza te oparte na dużych modelach, często działają jak "czarne skrzynki" – trudno wyjaśnić, dlaczego podjęły konkretną decyzję, np. odrzuciły wniosek kredytowy czy oznaczyły treść jako szkodliwą. To rodzi pytania o sprawiedliwość i możliwość odwołania się od decyzji podejmowanych przez automatyczne systemy. W odpowiedzi na te wyzwania, organizacje wdrażają narzędzia do audytowania modeli, takie jak IBM AI Fairness 360 czy Google What-If Tool, które pozwalają analizować potencjalne uprzedzenia i błędy algorytmów.

Kwestia równego traktowania użytkowników nabiera szczególnego znaczenia w przypadku języka polskiego i innych mniej popularnych języków. Modele NLP trenowane głównie na danych anglojęzycznych mogą faworyzować jedne grupy społeczne kosztem innych, co prowadzi do wykluczeń lub błędnej interpretacji treści. Przykładem są systemy rekrutacyjne czy chatboty obsługujące klientów – jeśli nie zadbamy o reprezentatywność danych i regularną walidację modeli, ryzykujemy powielanie stereotypów lub dyskryminację użytkowników.

Kolejnym istotnym aspektem jest prywatność i ochrona danych osobowych przetwarzanych przez narzędzia NLP. W 2026 roku coraz więcej firm korzysta z rozwiązań chmurowych, gdzie dane tekstowe klientów podlegają automatycznej analizie i przechowywaniu. Przedsiębiorstwa muszą jasno informować użytkowników o zakresie przetwarzania, stosować anonimizację oraz wdrażać narzędzia do kontroli dostępu. Bez tego trudno mówić o odpowiedzialnym wykorzystaniu NLP w praktyce biznesowej.

Odpowiedzialność za etyczne wdrażanie NLP spoczywa zarówno na twórcach modeli, jak i na firmach wdrażających gotowe rozwiązania. Coraz częściej powstają wewnętrzne kodeksy postępowania, a także niezależne audyty i certyfikacje, które mają ograniczać ryzyko nadużyć. Dla polskich przedsiębiorstw oznacza to nie tylko przestrzeganie prawa, ale też budowanie długofalowego zaufania klientów i partnerów biznesowych. W kontekście rozwoju AI w Polsce, to wyzwanie, które warto potraktować priorytetowo.

Moja refleksja: Przyszłość NLP w polskich firmach – szanse i zagrożenia

Rozwój natural language processing w Polsce wyraźnie przyspieszył po 2022 roku, kiedy to pierwsze firmy zaczęły masowo testować modele językowe, takie jak GPT-4 czy polskojęzyczne BERTy. Dziś, w 2026 roku, coraz więcej przedsiębiorstw – od średnich e-commerce po instytucje finansowe – korzysta z NLP nie tylko do automatyzacji obsługi klienta, ale także do analizy dokumentów prawnych, przetwarzania umów czy monitorowania opinii w sieci. To nie jest już eksperyment – to codzienne narzędzie pracy, które może przełożyć się na realny wzrost wydajności nawet o 30% według danych PIIT z końca 2025 roku.

Patrząc z punktu widzenia polskich firm, największą szansą jest możliwość skalowania usług bez konieczności zatrudniania dużych zespołów. Wdrożenie rozwiązań opartych o spaCy, Hugging Face Transformers czy platformy typu Google Vertex AI pozwala nie tylko przyspieszyć obsługę klienta, ale też lepiej zrozumieć potrzeby rynku. Jednocześnie pojawia się wyzwanie: jak zachować unikalność komunikacji i dbać o jakość danych w języku polskim, który wciąż jest mniej wspierany niż angielski. Zdarza się, że modele mylą kontekst lub nie radzą sobie z żargonem branżowym – szczególnie w sektorze medycznym czy prawnym.

Nie ukrywam, że obserwuję też pewien sceptycyzm wśród zarządów: "Czy NLP rzeczywiście zastąpi ludzi?" – to pytanie słyszę regularnie podczas konsultacji. Odpowiadam wtedy: nie chodzi o zastępowanie, a o rozsądne wsparcie zespołów i automatyzację powtarzalnych zadań. Dobrze wdrożone NLP potrafi uwolnić potencjał pracowników, pozwalając im skupić się na bardziej kreatywnych i strategicznych zadaniach. Przykładem są firmy, które dzięki automatyzacji analizy dokumentów skróciły procesy decyzyjne z tygodni do kilku godzin.

Zagrożenia? Oprócz znanych już ryzyk związanych z prywatnością i bezpieczeństwem danych, coraz częściej pojawia się temat "AI bias" – uprzedzeń algorytmicznych, które mogą prowadzić do błędnych decyzji biznesowych. W polskich realiach problematyczne bywa także uzależnienie od zagranicznych API oraz brak wystarczającej liczby specjalistów, którzy rozumieją nie tylko kod, ale i specyfikę języka polskiego. Jeśli firmy chcą naprawdę wykorzystać szanse, muszą inwestować nie tylko w technologię, ale i w ludzi.

Na koniec osobista myśl: NLP to narzędzie, które – jeśli zostanie dobrze zaadaptowane – może być dla polskich firm tym, czym automatyzacja produkcji była dla przemysłu. Cytując jednego z moich klientów: "Największą przewagą nie jest sama technologia, tylko sposób, w jaki ją wdrożysz". I z tym zostawiam czytelników digitalportal.pl.

Podsumowanie

Artykuł wyjaśnia, jak NLP przeobraża komunikację ludzi z technologią w 2026 roku. Omawia rozwój przetwarzania języka naturalnego – od dawnych systemów regułowych po dzisiejsze modele generatywne, takie jak LLM. Przedstawia realne zastosowania w polskim biznesie, np. w bankowości, e-commerce czy obsłudze klienta. Pokazuje, jak dobrać narzędzia i biblioteki, a także na jakie wyzwania i pułapki uważać (np. wieloznaczność języka, etyka, prywatność). Tekst podsumowuje najnowsze trendy, w tym prompt engineering i odpowiedzialne wdrażanie AI. To praktyczny przewodnik dla firm i specjalistów chcących skutecznie wykorzystać NLP do rozwoju produktów i usług.

Najczesciej zadawane pytania

Jakie są podstawowe kroki wdrożenia NLP w małej firmie?

Czy przetwarzanie języka naturalnego wymaga dużych zasobów IT?

Jakie są koszty wdrożenia rozwiązań NLP w polskich realiach?

Czy polskie firmy mogą korzystać z gotowych modeli językowych, czy lepiej trenować własne?

Jak można ocenić skuteczność wdrożonego rozwiązania NLP?