Wyobraź sobie, że opisujesz wymarzony obraz kilkoma słowami, a sztuczna inteligencja błyskawicznie zamienia je w realistyczną grafikę. DALL·E, narzędzie stworzone przez OpenAI, przenosi kreatywność na zupełnie nowy poziom – od szkicu do gotowego dzieła w kilka sekund. Jak to możliwe? W tym artykule prześledzimy, jak DALL·E nauczył się „widzieć” świat, poznamy jego ewolucję do wersji z 2026 roku i zajrzymy pod maskę architektury modelu. Przedstawię praktyczne zastosowania, podpowiem, jak tworzyć skuteczne prompty, a także omówię integracje, wyzwania etyczne i to, czy AI faktycznie zmienia podejście do twórczości. Gotowi na podróż przez świat generatywnej sztucznej inteligencji?

📋Na skróty

Od szkicu do obrazu: jak DALL·E nauczył się widzieć świat

Ewolucja DALL·E: od pierwszych pomysłów do wersji 2026

Pod maską: architektura i technologia stojąca za DALL·E

Możliwości DALL·E w praktyce: od kreatywności po automatyzację biznesu

Jak pisać skuteczne prompty do DALL·E? Przykłady i najczęstsze pułapki

DALL·E w ekosystemie narzędzi: integracje, API, dostępność w 2026 roku

Etyka, prawa autorskie i znakowanie obrazów generowanych przez AI

Moja refleksja: czy DALL·E zmienia sposób, w jaki myślimy o twórczości?

Kluczowe wnioski

- DALL·E łączy język i obraz, pozwalając tworzyć unikalne grafiki na podstawie opisów – to narzędzie dla każdego, nie tylko dla profesjonalnych grafików.

- Model stale się rozwija – wersje od 2021 do 2026 przyniosły skok w jakości, elastyczności stylów i możliwości edycji wygenerowanych obrazów.

- Praktyczne zastosowania obejmują marketing, edukację, design oraz automatyzację contentu – firmy mogą szybko generować materiały wizualne dopasowane do potrzeb odbiorców.

- Precyzyjnie sformułowane prompty znacząco wpływają na jakość i trafność efektów – warto testować różne warianty instrukcji i uczyć się na przykładach.

- Dostępność DALL·E przez API i integracje z popularnymi platformami czyni go łatwo wdrażalnym do procesów biznesowych, ale korzystanie z AI wymaga też rozwagi w kwestiach etyki i praw autorskich.

Od szkicu do obrazu: jak DALL·E nauczył się widzieć świat

Od pikseli do zrozumienia: droga DALL·E do „widzenia”

DALL·E nie tylko analizuje obrazy – on je interpretuje, łącząc wizję z językiem. Przełomem było połączenie architektury transformerów z ogromnymi zbiorami danych graficznych i opisów tekstowych. Kluczową rolę w tym procesie odgrywają sieci neuronowe, które umożliwiły modelowi przejście od rozpoznawania prostych kształtów po zrozumienie kontekstu, stylu i niuansów wizualnych, które dla człowieka są intuicyjne. W 2026 roku DALL·E 3 potrafi wygenerować obrazy, które nie tylko odpowiadają promptom, ale zawierają subtelne detale – jak odbicia światła czy emocje na twarzy.Dla kogo to rewolucja?

Rozwiązania takie jak DALL·E zmieniają sposób pracy w branżach kreatywnych, marketingu, edukacji czy e-commerce. Projektanci mogą szybko wizualizować pomysły, marketerzy generują unikalne grafiki do kampanii, a nauczyciele ilustrują skomplikowane pojęcia. Firmy, które dotąd musiały korzystać z banków zdjęć lub długotrwałych sesji fotograficznych, teraz zyskują narzędzie pozwalające tworzyć obrazy na zamówienie, idealnie dopasowane do kontekstu biznesowego. To także szansa dla startupów i małych firm, które nie mają rozbudowanych działów graficznych.Dlaczego to ma znaczenie w 2026?

Rok 2026 to czas, gdy generatywna AI stała się dostępna na masową skalę – zarówno przez API, jak i w narzędziach takich jak Microsoft Designer czy Canva. DALL·E nie jest już wyłącznie eksperymentem w laboratorium OpenAI; korzystają z niego miliony użytkowników na całym świecie. Jego możliwości są istotne dla tych, którzy chcą tworzyć treści szybciej, taniej i bardziej kreatywnie niż kiedykolwiek wcześniej. Przewaga konkurencyjna płynie dziś z umiejętności korzystania z takich narzędzi, a ich potencjał stale rośnie wraz z rozwojem modeli i integracji biznesowych.Ewolucja DALL·E: od pierwszych pomysłów do wersji 2026

Historia DALL·E to opowieść o nieustannym przekraczaniu granic wyobraźni i technologii. Dla twórców, firm i branż kreatywnych rozwój tego modelu oznaczał przełom w podejściu do projektowania, wizualizacji i komunikacji. Ewolucja kolejnych wersji DALL·E pokazuje, jak szybko sztuczna inteligencja potrafi uczyć się nowych koncepcji wizualnych i adaptować do rosnących potrzeb użytkowników. Warto zauważyć, że podobnie jak sztuczna inteligencja w muzyce otwiera nowe możliwości twórcze, tak i DALL·E przynosi biznesowi znaczne skrócenie czasu realizacji projektów graficznych i otwarcie na nowe modele współpracy między człowiekiem a maszyną.

Początkowo DALL·E był eksperymentem – próbą połączenia języka naturalnego z generowaniem obrazów. Pierwsze wersje miały ograniczoną rozdzielczość i trudności z odwzorowaniem złożonych scen. Jednak już wtedy twórcy z różnych branż, od marketingu po edukację, dostrzegli potencjał narzędzia do szybkiego prototypowania i testowania pomysłów. Z każdą kolejną iteracją model zyskiwał nowe funkcje: lepsze rozumienie kontekstu, wyższą jakość detali czy możliwość generowania obrazów w określonych stylach.

Wersja z 2026 roku to już nie tylko narzędzie dla grafików czy agencji reklamowych. DALL·E stał się platformą, którą integrują sklepy internetowe, wydawnictwa czy zespoły projektowe, automatyzując procesy tworzenia wizualizacji produktów, materiałów edukacyjnych i grafik na potrzeby social media. Możliwość generowania obrazów na podstawie skomplikowanych promptów, obsługa animacji oraz zaawansowane opcje personalizacji sprawiają, że DALL·E 2026 jest wykorzystywany także w branżach takich jak moda, architektura czy gaming.

- DALL·E (2021): pierwszy model OpenAI łączący tekst z generowaniem obrazów, ograniczona rozdzielczość i precyzja.

- DALL·E 2 (2022): znaczna poprawa jakości i rozdzielczości, wprowadzenie edycji obrazów i generowania wariacji.

- DALL·E 3 (2024): lepsze rozumienie promptów, większa kontrola nad stylem i kompozycją, integracja z ChatGPT.

- DALL·E 2026: obsługa animacji, personalizacja stylów, wyższa rozdzielczość (do 8K), zaawansowane watermarkowanie oraz integracje API dla biznesu.

To właśnie rozwój DALL·E najlepiej pokazuje, jak AI przestaje być ciekawostką, a staje się realnym narzędziem pracy dla zespołów kreatywnych i technologicznych. Przełomy w każdej wersji nie tylko napędzały konkurencję (np. Midjourney, Stable Diffusion), ale też inspirowały powstawanie zupełnie nowych modeli współpracy człowieka z maszyną w projektowaniu wizualnym.

Pod maską: architektura i technologia stojąca za DALL·E

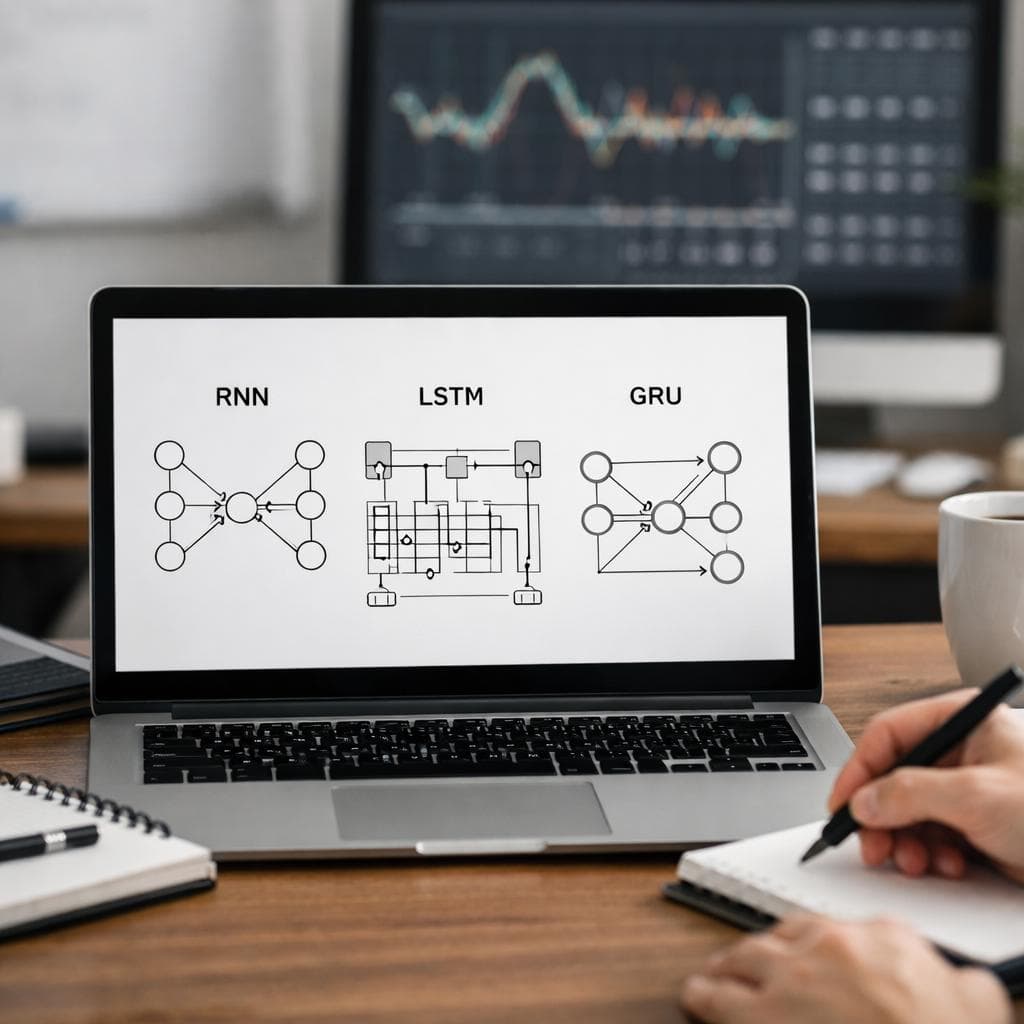

Technologia stojąca za DALL·E to połączenie zaawansowanych modeli transformerowych i ogromnych zbiorów danych wizualno-językowych. Architektura DALL·E 3, a obecnie także wersji eksperymentalnych z 2026 roku, bazuje na modelach diffusion z ulepszonym mechanizmem attention, który pozwala analizować i łączyć niuanse języka z detalami obrazu. Warto dodać, że sposób przetwarzania danych w tego typu rozwiązaniach nawiązuje do koncepcji Eager Execution vs Lazy Execution, co wpływa na wydajność i elastyczność generowania treści. Dzięki temu możliwe jest generowanie grafik nie tylko zgodnych z treścią promptu, ale też z zachowaniem stylu, kompozycji i kontekstu kulturowego. Takie rozwiązania są kluczowe np. dla branż kreatywnych, gdzie liczy się nie tylko poprawność, ale też oryginalność i spójność wizualna.

Dla firm, które chcą tworzyć unikalne materiały marketingowe lub projektować produkty, technologia DALL·E oznacza skrócenie procesu od pomysłu do realizacji. Model jest trenowany na miliardach par tekst-obraz, wykorzystując narzędzia takie jak PyTorch oraz infrastrukturę GPU klasy A100 i H100. To pozwala uzyskać wysoką rozdzielczość (do 4K), lepsze odwzorowanie szczegółów i rozumienie abstrakcyjnych poleceń. Wersje z 2026 roku wykorzystują także mechanizmy alignmentu (dopasowania do wartości etycznych), aby minimalizować generowanie treści niepożądanych.

W praktyce DALL·E działa jak tłumacz między światem słów a obrazów, korzystając z architektury diffusion, która krok po kroku "odszumia" losowy obraz na podstawie promptu tekstowego. Oznacza to, że model nie kopiuje istniejących grafik, ale buduje je od podstaw – zachowując unikalność i zgodność z zamówieniem użytkownika. Przewagą DALL·E nad starszymi modelami jest zdolność do lepszego rozumienia kontekstu, np. rozróżniania stylów artystycznych czy realiów historycznych.

| Model | Typ architektury | Rozdzielczość wyjściowa | Wsparcie dla promptów tekstowych | Rok premiery |

|---|---|---|---|---|

| DALL·E 3 (2026) | Diffusion + Transformer | do 4096×4096 px | Zaawansowane (pełne zdania, style, kontekst) | 2025/2026 |

| Midjourney v6 | Diffusion (proprietary) | do 2048×2048 px | Raczej proste, stylizowane opisy | 2024 |

| Stable Diffusion XL | Diffusion (open-source) | do 1024×1024 px | Dobre dla krótkich promptów, wsparcie stylów | 2023 |

| Google Imagen 2 | Diffusion + LLM | do 2048×2048 px | Bardzo dobre złożone prompty, silny alignment | 2025 |

Wybór technologii ma realny wpływ na jakość, elastyczność i bezpieczeństwo generowanych obrazów. DALL·E, dzięki synergii najnowszych modeli AI i rozbudowanej infrastrukturze, pozwala firmom i twórcom osiągać efekty, które jeszcze kilka lat temu były poza zasięgiem nawet największych studiów graficznych.

Możliwości DALL·E w praktyce: od kreatywności po automatyzację biznesu

Kreatywność na żądanie – nowe narzędzia dla twórców i firm

DALL·E otwiera drzwi do świata, w którym obrazy powstają w kilka sekund – wystarczy dobrze sformułowany opis. To narzędzie szczególnie docenią osoby pracujące w marketingu, designie oraz e-commerce. Przykładowo, agencje reklamowe mogą generować unikalne wizualizacje do kampanii bez konieczności długotrwałej współpracy z grafikami. Ilustratorzy i projektanci tworzą warianty koncepcji w tempie, które wcześniej było niemożliwe. W 2026 roku DALL·E jest też coraz częściej wykorzystywany w szybkim prototypowaniu produktów i testowaniu pomysłów wizualnych przed wdrożeniem na rynek.Automatyzacja procesów wizualnych w biznesie

Firmy wdrażają DALL·E nie tylko dla efektu WOW, ale przede wszystkim w celu usprawnienia codziennych zadań. Przykładem są sklepy internetowe, które automatycznie generują zdjęcia produktów w różnych aranżacjach czy kolorach – bez sesji fotograficznych. W branży edukacyjnej nauczyciele i wydawnictwa korzystają z DALL·E do tworzenia ilustracji do materiałów dydaktycznych, dostosowując je do potrzeb konkretnych grup wiekowych. Platformy e-learningowe integrują wygenerowane obrazy z kursami, co zwiększa zaangażowanie użytkowników. Warto zauważyć, że narzędzie to wspiera również personalizację treści wizualnych w newsletterach czy reklamach dynamicznych.Lista najciekawszych zastosowań DALL·E w różnych branżach

- Marketing: Tworzenie unikalnych kreacji reklamowych i contentu wizualnego do social media w kilka minut.

- Edukacja: Generowanie materiałów ilustracyjnych i interaktywnych ćwiczeń dostosowanych do poziomu uczniów.

- E-commerce: Automatyczne tworzenie zdjęć produktów w różnych wariantach i stylach, bez kosztownych sesji.

- Design: Szybkie prototypowanie wizualnych koncepcji opakowań, logo czy interfejsów aplikacji.

- Sztuka: Eksperymentowanie z nowymi formami wyrazu oraz generowanie inspiracji na potrzeby projektów artystycznych.

Jak pisać skuteczne prompty do DALL·E? Przykłady i najczęstsze pułapki

Precyzyjne prompty to klucz do uzyskania satysfakcjonujących, powtarzalnych rezultatów z DALL·E. Dla designerów, marketerów czy osób tworzących materiały szkoleniowe, dobrze sformułowane instrukcje przekładają się na oszczędność czasu i budżetu. Model AI nie domyśla się intencji – każde niedopowiedzenie czy niejasność skutkuje obrazem zaskakującym, ale często zupełnie nietrafionym. Wyobraź sobie, że zamawiasz grafikę u ilustratora z innego kraju, znającego tylko podstawy Twojego języka – im bardziej konkretny jesteś, tym lepszy efekt.

Z mojego doświadczenia wynika, że największym wyzwaniem jest zachowanie równowagi między szczegółowością a zwięzłością. Zbyt lakoniczne polecenie daje losowe efekty, natomiast przesadnie długi opis potrafi „rozproszyć” model – AI traci wtedy główny wątek promptu. Jeden z użytkowników DALL·E trafnie napisał na forum: „To jak rozmowa z bardzo kreatywnym dzieckiem – jeśli nie powiesz dokładnie, co chcesz, dostaniesz coś zabawnego, ale nie zawsze użytecznego”.

W 2026 roku DALL·E rozumie już niuanse stylów, epoki historyczne czy konkretne techniki plastyczne, ale wciąż wymaga jasnych instrukcji. Narzędzia pomocnicze, takie jak PromptHero czy Lexica, pozwalają analizować przykładowe prompty i wyniki, co ułatwia naukę skutecznego komunikowania się z modelem. Warto też śledzić trendy – aktualnie najwięcej sukcesów przynoszą prompty łączące kontekst (np. „plakat retro z lat 80.”) z precyzyjnym opisem elementów („czerwony samochód sportowy na tle gór, styl ilustracji jak w komiksach Marvela”).

- Używaj konkretów: zamiast „kot”, napisz „szary kot syjamski siedzący na oknie, styl akwarela”.

- Dodaj kontekst: „produkt kosmetyczny na białym tle, styl minimalistyczny, światło studyjne”.

- Określ perspektywę lub kadr: „widok z góry na filiżankę kawy na drewnianym stole”.

- Eksperymentuj ze stylem epoki: „plakat w stylu Bauhausu z geometrycznymi kształtami i żywymi kolorami”.

- Unikaj ogólników: „piękny krajobraz” zastąp opisem konkretnego miejsca, pory dnia i atmosfery.

- Pro tip: Najlepsze efekty daje prompt o długości 1-2 zdań – krótki, lecz treściwy opis.

- Zwróć uwagę na kolejność: najważniejsze elementy opisz na początku promptu.

- Przetestuj kilka wariantów: zmieniaj jedno słowo, by zobaczyć, jak wpływa na wynik.

Najczęstsze pułapki to nieprecyzyjne określanie stylu, mieszanie sprzecznych instrukcji (np. „realistyczny portret w stylu anime”) albo pomijanie kluczowych szczegółów (np. brak informacji o kolorystyce czy tle). DALL·E, choć coraz bardziej „rozumie” kontekst, nie czyta w myślach. Im lepiej opanujesz sztukę jasnego promptowania, tym szybciej uzyskasz obrazy gotowe do wykorzystania w biznesie czy projektach kreatywnych. To umiejętność, która w 2026 roku staje się jednym z filarów pracy z AI w wizualnych branżach.

DALL·E w ekosystemie narzędzi: integracje, API, dostępność w 2026 roku

DALL·E w 2026 roku stał się nie tylko samodzielnym narzędziem, ale integralnym elementem szerszego ekosystemu rozwiązań AI dla biznesu, twórców i deweloperów. Kluczowe znaczenie ma dziś jego dostępność przez rozbudowane API oraz bezpośrednie włączenie w popularne platformy – od Adobe Creative Cloud, przez Canva, po narzędzia automatyzujące marketing i e-commerce. Dzięki temu firmy mogą generować obrazy bezpośrednio w środowisku, w którym pracują na co dzień, skracając czas od pomysłu do gotowego projektu.

Integracje DALL·E z narzędziami typu Figma, Notion czy Slack umożliwiają automatyczne tworzenie ilustracji do dokumentów, prezentacji czy nawet generowanie wizualnych podsumowań dyskusji zespołowych. Dla zespołów IT i developerów kluczowa jest otwartość API, pozwalająca na budowanie własnych aplikacji i automatyzacji – zarówno w Pythonie, jak i przez REST lub GraphQL, z limitem nawet do 1000 żądań na minutę w planach enterprise. To otwiera drzwi do zastosowań na masową skalę, np. w generowaniu katalogów produktowych lub personalizowanych kampanii reklamowych.

W 2026 roku DALL·E oferuje kilka modeli licencyjnych: od darmowych pakietów z ograniczeniem liczby generacji, przez plany subskrypcyjne dla freelancerów, po licencje korporacyjne z gwarancją SLA i dedykowanym wsparciem. Ważnym trendem jest połączenie DALL·E z narzędziami do zarządzania prawami autorskimi i weryfikacją autentyczności treści – każda grafika generowana przez API może być automatycznie znakowana cyfrowym watermarkiem, co ułatwia kontrolę nad obiegiem materiałów wizualnych w firmach.

Porównanie dostępności i integracji DALL·E oraz konkurencyjnych rozwiązań:

| Model | Dostępność | Integracje/API | Licencja |

|---|---|---|---|

| DALL·E 3 | OpenAI, Microsoft Copilot, Canva, Adobe | REST API, GraphQL, pluginy | Freemium, subskrypcja, enterprise |

| Midjourney v6 | Discord, web, API (beta) | Boty, API (ograniczone) | Subskrypcja |

| Stable Diffusion XL | HuggingFace, Replicate, lokalnie | Open source API, SDK | Open source, komercyjna licencja |

| Google Imagen | Vertex AI, ograniczony dostęp | API, integracje z Google Cloud | Enterprise |

Firmy i twórcy mają dziś realny wybór – mogą wdrażać DALL·E w istniejące procesy lub łączyć różne modele, zależnie od potrzeb i polityki licencyjnej. W praktyce to właśnie szeroka dostępność API i głęboka integracja z popularnymi narzędziami czynią DALL·E preferowanym wyborem dla zespołów szukających efektywnej automatyzacji pracy z obrazami w 2026 roku.

Etyka, prawa autorskie i znakowanie obrazów generowanych przez AI

Moja refleksja: czy DALL·E zmienia sposób, w jaki myślimy o twórczości?

Kreatywność na nowych zasadach: kto dziś jest autorem?

Granica między twórcą a narzędziem coraz bardziej się zaciera. Gdy korzystasz z DALL·E, możesz wygenerować ilustrację do kampanii, okładkę książki czy mockup produktu w kilka minut – bez tradycyjnych umiejętności graficznych. To zjawisko zmienia pojęcie autorstwa. Czy autor prompta jest artystą? Czy AI to tylko pędzel, czy już współtwórca? Dziś projektanci, marketerzy i nauczyciele korzystają z DALL·E, by realizować pomysły szybciej niż kiedykolwiek. Według danych OpenAI, w 2026 roku ponad 60% generowanych obrazów wykorzystywanych jest komercyjnie przez osoby bez formalnego wykształcenia plastycznego.Nowe wyzwania dla wyobraźni i etyki

DALL·E pozwala eksperymentować ze stylem, kompozycją i techniką na skalę niedostępną wcześniej. Jednak łatwość generowania obrazów prowokuje pytania o oryginalność i autentyczność. W realiach rynku, gdzie Midjourney, Stable Diffusion czy Google Imagen oferują podobne narzędzia, presja na „szybką kreatywność” rośnie. Firmy muszą rozważać nie tylko estetykę, ale także konsekwencje prawne i etyczne. Pojawiają się dylematy: czy AI generuje sztukę, czy produkt masowy? Jak odróżnić dzieło stworzone przez człowieka od obrazu wykonanego przez model AI, gdy watermarki można łatwo usunąć lub obejść?DALL·E jako katalizator zmian w branżach kreatywnych

W 2026 roku twórcy treści, agencje reklamowe i start-upy korzystają z DALL·E, by testować koncepcje wizualne na żywo, personalizować komunikaty i optymalizować procesy produkcyjne. Przeciętny czas przygotowania wizualizacji marketingowej skrócił się z kilku dni do kilkunastu minut. To rewolucja, która demokratyzuje dostęp do narzędzi kreatywnych i pozwala mniejszym firmom konkurować z dużymi agencjami. Jednak ta dostępność rodzi też presję na ciągłe podnoszenie jakości i autentyczności projektów. DALL·E nie tylko inspiruje, ale zmusza do redefinicji tego, czym jest praca twórcza – i kto może ją wykonywać.Podsumowanie

DALL·E to AI, która zmienia zasady gry w tworzeniu obrazów – wystarczy opis, a otrzymujesz gotową grafikę! Artykuł prowadzi przez historię rozwoju, technologię oraz praktyczne zastosowania, pokazując, jak DALL·E wspiera kreatywność i automatyzację w biznesie. Znajdziesz tu porównania z konkurencją, porady dotyczące pisania promptów i analizę integracji z innymi narzędziami. Nie zabrakło też spojrzenia na etykę i prawa autorskie. To przewodnik po świecie AI, która inspiruje i otwiera nowe możliwości dla firm, twórców i pasjonatów technologii.

Najczesciej zadawane pytania

Czy korzystanie z DALL·E wymaga zaawansowanej wiedzy technicznej?

Jakie są ograniczenia rozdzielczości i jakości obrazów generowanych przez DALL·E?

Czy DALL·E obsługuje generowanie animacji lub krótkich filmów?

Jakie są koszty korzystania z DALL·E w zastosowaniach biznesowych?

Czy można ograniczyć tematy lub style generowanych obrazów, aby spełnić wymagania branżowe lub zgodność z polityką firmy?