Paperspace od kilku lat przyciąga uwagę firm i zespołów pracujących nad projektami AI, machine learning i wymagającymi dużych zasobów GPU. Platforma stawia na prostotę, szybkość działania i elastyczność w zarządzaniu mocą obliczeniową – zarówno dla startupów, jak i większych organizacji. W tym artykule przyjrzymy się, jak Paperspace działa w praktyce, jakie funkcje (Gradient, Core, API) wyróżniają ją na tle chmurowych gigantów, komu rzeczywiście pomaga oraz jak zacząć z niej korzystać. Sprawdzimy też, jak wypada w porównaniu z AWS, Google Cloud czy Azure i podpowiemy, jak optymalnie zarządzać budżetem oraz zasobami GPU. Czy Paperspace to realna szansa dla polskich firm w 2026 roku?

📋Na skróty

Paperspace – co to za platforma i jak działa w praktyce?

Najważniejsze funkcje Paperspace: GPU, AI/ML, Gradient, Core, API

Dla kogo powstał Paperspace? Segmenty użytkowników w 2026 roku

Jak zacząć korzystać z Paperspace – przewodnik krok po kroku

Paperspace vs. AWS, Google Cloud, Azure – porównanie platform chmurowych

Zalety i ograniczenia Paperspace z punktu widzenia firmy

Jak optymalizować koszty i zarządzać zasobami GPU na Paperspace?

Refleksja: Czy Paperspace to dobra inwestycja dla polskich firm w 2026 roku?

Kluczowe wnioski

- Paperspace umożliwia szybkie uruchamianie środowisk GPU do AI, ML i obliczeń – bez skomplikowanej konfiguracji, co przyspiesza start projektów biznesowych.

- Platforma oferuje gotowe narzędzia (Gradient, Core, API) i elastyczny wybór maszyn – od pojedynczych instancji po skalowalne klastry dla dużych zespołów i firm.

- W porównaniu do AWS, Google Cloud i Azure, Paperspace wyróżnia się prostotą obsługi, transparentnym modelem kosztowym i dostępnością najnowszych kart graficznych.

- Dla polskich firm kluczowe są możliwości optymalizacji wydatków na GPU – Paperspace pozwala na harmonogramowanie, rezerwacje i automatyczne zarządzanie zasobami.

- Platforma jest atrakcyjna dla startupów, zespołów R&D oraz edukatorów, którzy chcą testować, prototypować i wdrażać rozwiązania AI bez inwestycji w fizyczną infrastrukturę.

<h3>Chmura GPU dla AI, ML i intensywnych obliczeń – na czym polega Paperspace?</h3>

Dlaczego Paperspace zyskuje popularność wśród firm i twórców?

W kontekście biznesowym Paperspace odpowiada na wyzwania, z jakimi mierzą się startupy, software house’y oraz firmy wdrażające AI – dostęp do wydajnych GPU, przewidywalne koszty oraz uproszczone zarządzanie środowiskami. Platforma umożliwia uruchamianie środowisk programistycznych "na żądanie" oraz integrację z narzędziami takimi jak TensorFlow, PyTorch, JupyterLab czy Docker. Dzięki temu zespoły mogą błyskawicznie przechodzić od prototypu do wdrożenia, bez barier technicznych typowych dla klasycznych serwerowni. Paperspace wspiera też automatyzację workflowów, co istotnie skraca czas potrzebny na eksperymenty i wdrożenia modeli AI.Kto i kiedy najwięcej zyskuje na korzystaniu z Paperspace?

Paperspace znajduje zastosowanie w firmach rozwijających własne modele AI, fintechach budujących systemy predykcyjne, a także w sektorze edukacyjnym, gdzie uczelnie i bootcampy uruchamiają zdalne laboratoria dla studentów. Platforma pozwala elastycznie zarządzać budżetem – płacisz tylko za faktycznie wykorzystane zasoby, co docenią zarówno startupy, jak i większe przedsiębiorstwa optymalizujące koszty IT. Paperspace sprawdza się też w zespołach rozproszonych, gdzie szybki dostęp do wspólnego środowiska pracy ułatwia współpracę nad projektami AI i ML, niezależnie od lokalizacji członków zespołu.Najważniejsze funkcje Paperspace: GPU, AI/ML, Gradient, Core, API

Elastyczna moc GPU dla wymagających projektów

Paperspace wyróżnia się dostępem do szerokiej gamy maszyn wyposażonych w nowoczesne karty graficzne NVIDIA, takich jak A100, H100, RTX 6000 czy V100. Pozwala to na uruchamianie projektów wymagających dużej mocy obliczeniowej — od trenowania modeli deep learning po wizualizacje 3D i symulacje naukowe. Warto podkreślić, że Paperspace świetnie sprawdza się również w zastosowaniach związanych z Natural Language Processing, gdzie kluczowe jest szybkie trenowanie i testowanie złożonych modeli przetwarzania języka naturalnego. Platforma umożliwia dynamiczne skalowanie zasobów, co docenią firmy prowadzące testy wydajnościowe lub pracujące nad rozwojem nowych produktów AI. Z punktu widzenia biznesu, oznacza to brak konieczności inwestowania w kosztowny sprzęt lokalny, a także możliwość rezerwacji GPU na godziny lub w trybie „on demand”.Gradient, Core i otwarte API — ekosystem dla AI i DevOps

Paperspace oferuje dwa główne produkty: Gradient i Core. Gradient to środowisko typu Jupyter Notebook zintegrowane z backendem GPU, idealne dla zespołów pracujących nad prototypami, analizą danych czy eksperymentami z modelami AI/ML. Pozwala korzystać z gotowych template’ów (np. PyTorch, TensorFlow, Hugging Face), automatyzować eksperymenty i wdrażać modele do produkcji. Core natomiast to klasyczna chmura maszyn wirtualnych — każda z własnym systemem operacyjnym i dedykowaną kartą graficzną, co sprawdza się w długoterminowych projektach lub przy budowie własnych środowisk developerskich. Paperspace API umożliwia pełną automatyzację zarządzania zasobami i integrację z workflowami DevOps, CI/CD czy narzędziami MLOps (np. MLflow, DVC).Dla kogo i w jakich scenariuszach Paperspace się sprawdza?

Z perspektywy programistów i data scientistów, platforma upraszcza dostęp do infrastruktury GPU — wystarczy kilka kliknięć, by uruchomić środowisko pracy z preinstalowanymi bibliotekami i wsparciem CUDA. Dla zespołów startupowych i firm, które nie chcą inwestować w własny sprzęt, Paperspace to sposób na szybkie uruchomienie projektów AI/ML lub testowanie nowych algorytmów w skali produkcyjnej. Edukatorzy i uczelnie korzystają z platformy do prowadzenia zajęć z uczenia maszynowego i analizy danych, bez potrzeby konfigurowania skomplikowanych labów.- GPU Machines – maszyny wirtualne z dedykowanymi kartami graficznymi NVIDIA, do obliczeń AI, renderingu i symulacji.

- Gradient – środowisko notebooków Jupyter zintegrowane z backendem GPU, do szybkiego prototypowania i eksperymentów AI/ML.

- Core – zarządzane VM z własnym systemem operacyjnym i dostępem do GPU, dla długoterminowych projektów i własnych środowisk developerskich.

- Paperspace API – narzędzia do automatyzacji zarządzania maszynami, integracji z CI/CD, DevOps i MLOps.

- Marketplace – gotowe obrazy systemowe i template’y (np. Stable Diffusion, CUDA, PyTorch, TensorFlow), ułatwiające szybki start projektów.

Dla kogo powstał Paperspace? Segmenty użytkowników w 2026 roku

W 2026 roku Paperspace przyciąga różnorodne środowiska, które potrzebują wysokowydajnych rozwiązań GPU oraz gotowych narzędzi do wdrażania AI i obliczeń. Platforma została zaprojektowana z myślą o użytkownikach, którzy oczekują nie tylko prostoty uruchamiania środowisk, ale także efektywnego zarządzania kosztami i integracji z popularnymi narzędziami developerskimi. Z punktu widzenia firmy, istotne jest, aby infrastruktura była elastyczna, skalowalna i łatwa do wdrożenia niezależnie od wielkości organizacji.

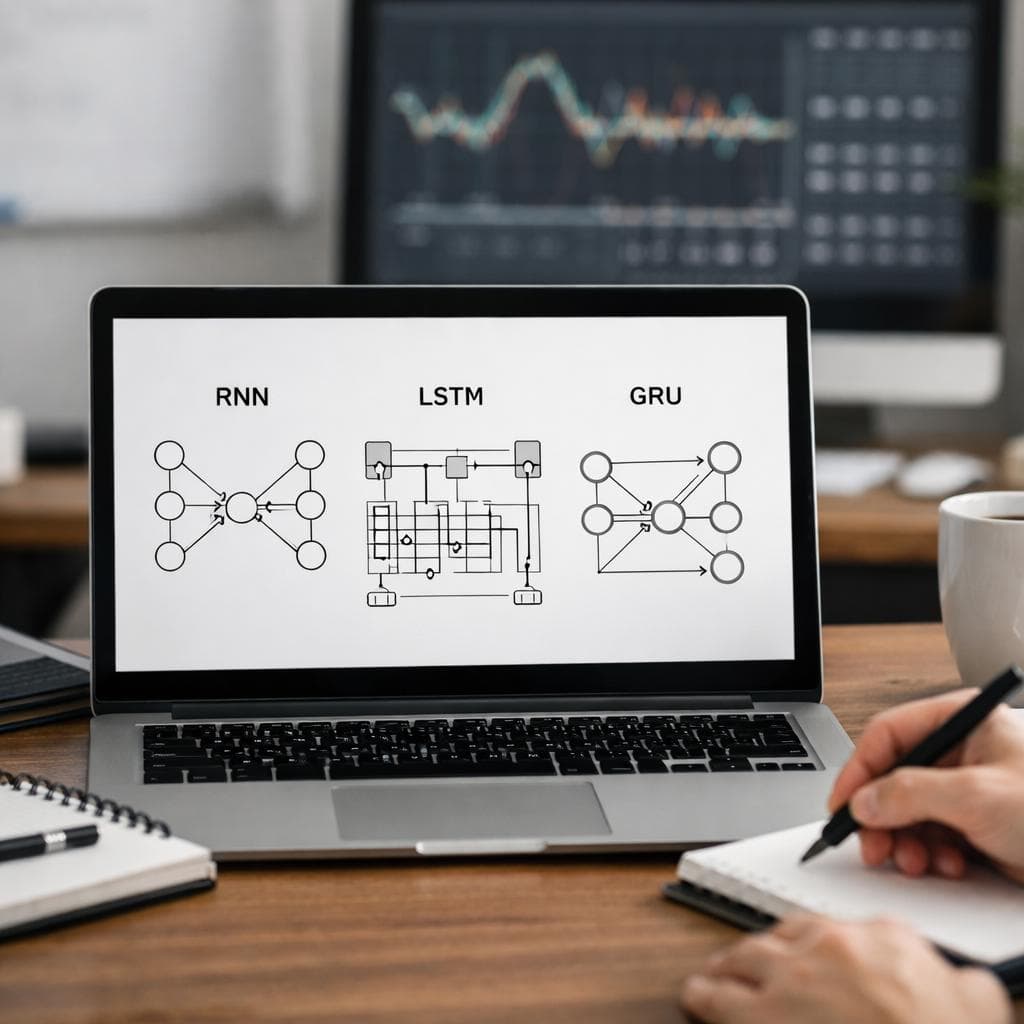

Największą wartość Paperspace oferuje tym, którzy prowadzą projekty związane z uczeniem maszynowym, analizą dużych zbiorów danych lub rozwojem aplikacji wymagających intensywnych zasobów obliczeniowych. W praktyce oznacza to zarówno zespoły projektujące modele deep learning w TensorFlow czy PyTorch, jak i startupy tworzące własne narzędzia SaaS lub firmy wdrażające przetwarzanie obrazu w czasie rzeczywistym. Przykładowo, edukatorzy i uczelnie korzystają z Paperspace do prowadzenia kursów AI bez inwestycji w lokalny sprzęt, a sektor badawczy – do realizacji obliczeń na dużą skalę bez ograniczeń sprzętowych. Wiele z tych zastosowań opiera się na wykorzystaniu nowoczesnych architektury sieci neuronowych, które pozwalają na skuteczną analizę sekwencji i przetwarzanie danych czasowych.

Różne branże wybierają Paperspace, bo mogą korzystać z gotowych środowisk Jupyter, integracji z MLOps (np. MLflow, Weights & Biases), a także wsparcia dla workflowów DevOps. Dla wielu liczy się także dostępność centrów danych w Europie i USA oraz możliwość wyboru maszyn z kartami NVIDIA A100, H100 czy RTX 6000. To przekłada się na realne korzyści, jak krótszy czas trenowania modeli, przewidywalność kosztów i szybkie skalowanie projektów bez inwestycji w infrastrukturę on-premise.

- Deweloperzy i zespoły AI/ML – budują i testują modele deep learning oraz aplikacje wymagające dużej mocy GPU.

- Firmy i korporacje – wdrażają automatyzacje, analitykę danych oraz obsługę AI w produktach cyfrowych na skalę produkcyjną.

- Startupy technologiczne – uruchamiają MVP i prototypy, korzystając z elastycznego rozliczania i łatwego skalowania zasobów.

- Sektor edukacyjny – prowadzi kursy i laboratoria z AI/ML bez inwestycji w lokalny sprzęt, z dostępem do nowoczesnych GPU.

- Instytucje badawcze – realizują projekty wymagające intensywnych obliczeń i dużych zbiorów danych, korzystając z gotowych narzędzi do zarządzania środowiskami.

Z perspektywy biznesu liczy się też dostęp do API, możliwości automatyzacji wdrożeń oraz łatwa integracja z narzędziami do zarządzania projektami – co przyspiesza prace i pozwala lepiej kontrolować budżet. Paperspace w 2026 roku odpowiada na potrzeby zarówno dużych organizacji, jak i małych zespołów, które chcą wykorzystać AI bez barier wejścia technologicznego.

Jak zacząć korzystać z Paperspace – przewodnik krok po kroku

Dlaczego warto dobrze zaplanować start z Paperspace?

Prawidłowe rozpoczęcie pracy z Paperspace ma bezpośredni wpływ na efektywność projektu, koszty i komfort użytkownika. Dla firm i zespołów pracujących nad AI, deep learningiem czy analizą danych, odpowiednie skonfigurowanie środowiska pozwala uniknąć niepotrzebnych wydatków oraz problemów z wydajnością. Osoby techniczne docenią możliwość pełnej kontroli nad zasobami, natomiast founderzy i managerowie mogą szybko uruchomić prototypy bez inwestycji w własną infrastrukturę. W 2026 roku platforma jest wykorzystywana zarówno przez startupy, jak i korporacje oraz uczelnie – każdy z tych segmentów zwraca uwagę na inne aspekty: elastyczność, bezpieczeństwo lub łatwość integracji.Rejestracja, wybór środowiska i pierwsze uruchomienie – etapy wdrożenia

Zaczynając przygodę z Paperspace, użytkownik przechodzi przez kilka kluczowych kroków. Po utworzeniu konta warto od razu określić, czy projekt wymaga środowiska typu Jupyter Notebook (Gradient), czy może „czystej” maszyny wirtualnej z GPU (Core). Dla zespołów AI rekomendowany jest Gradient – pozwala na szybkie testy modeli oraz współpracę w czasie rzeczywistym. Z kolei dla zastosowań produkcyjnych lub niestandardowych frameworków (np. TensorFlow, PyTorch, Stable Diffusion) lepiej sprawdzi się Core, gdzie użytkownik samodzielnie zarządza systemem operacyjnym i bibliotekami. Po wyborze środowiska można uruchomić projekt z poziomu przeglądarki lub przez API.| Etap | Opis |

|---|---|

| Rejestracja | Założenie konta Paperspace, weryfikacja maila, wybór planu (Free/Pro/Enterprise) |

| Wybór środowiska | Gradient (notebooki, AI/ML) lub Core (maszyny wirtualne, pełna kontrola nad GPU) |

| Konfiguracja zasobów | Wybór typu GPU (np. A100, H100, RTX 6000), ilości RAM, przestrzeni dyskowej |

| Uruchomienie projektu | Start środowiska, instalacja niezbędnych narzędzi (np. CUDA, frameworki AI), import danych |

Na co zwrócić uwagę podczas pierwszego wdrożenia?

Przed uruchomieniem projektu warto przemyśleć harmonogram wykorzystania GPU oraz sposób zarządzania budżetem – Paperspace oferuje rozliczenia za czas pracy, co pozwala na precyzyjną kontrolę kosztów. Użytkownicy biznesowi powinni sprawdzić integracje z narzędziami DevOps i MLOps, takimi jak GitHub Actions czy MLflow. W praktyce dobrym rozwiązaniem jest korzystanie z harmonogramów automatycznego wyłączania nieużywanych maszyn, co minimalizuje ryzyko nieplanowanych wydatków. Dla osób rozpoczynających pracę z AI, Paperspace udostępnia gotowe obrazy z najnowszymi wersjami bibliotek, dzięki czemu można uruchomić eksperymenty w ciągu kilku minut.Paperspace vs. AWS, Google Cloud, Azure – porównanie platform chmurowych

Porównanie Paperspace z gigantami chmury publicznej – AWS, Google Cloud i Azure – to temat, który regularnie pojawia się w rozmowach z founderami i szefami zespołów AI. Dlaczego? Bo od wyboru platformy zależy nie tylko wydajność projektu, ale też budżet, elastyczność i tempo rozwoju. Dla startupów i mniejszych firm, które chcą szybko wdrożyć modele uczenia maszynowego lub trenować sieci neuronowe na mocnych GPU, liczy się nie tylko dostęp do najnowszych kart, ale też prostota rozliczeń i łatwość zarządzania środowiskiem. Dla dużych organizacji istotna jest natomiast integracja z istniejącą infrastrukturą, compliance oraz szeroki ekosystem narzędzi.

Z perspektywy praktyka największą przewagą Paperspace jest koncentracja na segmencie AI/ML. Platforma daje szybki dostęp do GPU NVIDIA (A100, H100, RTX 6000) często bez konieczności konfigurowania złożonych polityk IAM czy rozbudowanego VPC, jak w AWS czy Azure. To skraca czas uruchomienia projektu: od rejestracji do gotowego środowiska minie niekiedy mniej niż 15 minut. AWS (np. EC2 P4d, G5) czy Google Cloud (A3, T4, L4) też oferują topowe GPU, ale ich konfiguracja wymaga większej znajomości ekosystemu i narzędzi CLI. W Paperspace doceniam także przejrzystość cennika – nie trzeba przekopywać się przez dziesiątki opcji i ukrytych opłat.

Jeśli chodzi o ceny, Paperspace bywa korzystniejszy dla krótkoterminowych zadań GPU (np. prototypowania, testów, hackathonów). Przykładowo, uruchomienie maszyny z NVIDIA A100 w Paperspace to wydatek ok. 2,30–2,60 USD za godzinę (marzec 2026), podczas gdy podobna instancja w AWS czy Azure potrafi kosztować nawet 3,10–3,50 USD/h – i to bez dodatkowych kosztów transferu czy storage. Google Cloud trzyma się podobnego poziomu cenowego co AWS. Z drugiej strony, duże organizacje korzystające z długoterminowych kontraktów czy programów saving plans mogą uzyskać lepsze stawki u dużych dostawców.

Wydajność? W praktyce – jeśli porównujemy te same modele GPU – różnice są marginalne i wynikają głównie z lokalizacji data center oraz przepustowości sieci. Paperspace prowadzi centra danych w USA i Europie, AWS, GCP i Azure mają globalny zasięg, co ma znaczenie dla firm działających na kilku kontynentach. Integracje: Paperspace jest kompatybilny z popularnymi workflowami MLOps (m.in. MLflow, Weights & Biases), ale AWS i GCP dają dostęp do własnych, rozbudowanych ekosystemów (np. SageMaker, Vertex AI), które mogą być atutem przy wdrożeniach enterprise.

| Platforma | Topowa GPU | Stawka za godzinę (A100/H100) | Centra danych | Ekosystem AI/ML |

|---|---|---|---|---|

| Paperspace | NVIDIA A100, H100 | 2,30–2,60 USD | USA, Europa | Gradient, API, MLflow |

| AWS | NVIDIA A100, H100 | 3,10–3,50 USD | Globalnie | SageMaker, własne CLI |

| Google Cloud | NVIDIA A100, L4 | 3,00–3,40 USD | Globalnie | Vertex AI, AutoML |

| Azure | NVIDIA A100, H100 | 3,20–3,50 USD | Globalnie | Azure ML, DevOps |

Pamiętam rozmowę z CTO pewnego polskiego startupu z branży healthtech, który powiedział mi: „Paperspace pozwolił nam wystartować z pierwszym modelem w jeden dzień, bez walki z politykami uprawnień i rozliczeniami – a to dla małego zespołu bez własnego działu IT robi różnicę”. To pokazuje, że czasem prostota i szybkość wdrożenia są ważniejsze niż rozbudowany ekosystem. Warto jednak przed wyborem platformy dokładnie przeanalizować specyfikę projektu, budżet i plany rozwoju – bo w dłuższej perspektywie różnice mogą się zniwelować.

Zalety i ograniczenia Paperspace z punktu widzenia firmy

Paperspace w 2026 roku to narzędzie, które zmienia podejście firm do wdrażania AI, analityki oraz obsługi dużych zbiorów danych. Dla biznesu oznacza to nie tylko uproszczenie procesu budowy środowisk GPU, ale także większą elastyczność w zarządzaniu kosztami i czasem wdrożeń. Perspektywa właściciela firmy lub CTO różni się od oczekiwań indywidualnego programisty – tu liczy się zarówno przewidywalność wydatków, jak i możliwość szybkiego skalowania zasobów bez inwestycji w infrastrukturę.

Firmy, które budują produkty AI, cenią Paperspace przede wszystkim za szybki dostęp do nowoczesnych GPU (np. NVIDIA H100, A100), gotowe środowiska do deep learning oraz prostą integrację z narzędziami typu Jupyter, GitHub czy popularnymi frameworkami ML (TensorFlow, PyTorch). W praktyce pozwala to zredukować czas wdrożenia prototypów nawet o 40-60% w porównaniu z przygotowywaniem własnych serwerów. Z drugiej strony, pojawiają się pytania o bezpieczeństwo danych, kontrolę nad środowiskiem oraz możliwość pełnej automatyzacji procesów (DevOps, MLOps).

Zarządzający zespołem IT docenią przejrzyste rozliczenia (rozliczenie godzinowe lub miesięczne), scentralizowany panel do kontroli kosztów i możliwość dynamicznego przydzielania GPU. Jednak w firmach z bardzo wysokimi wymaganiami compliance lub niestandardowymi workflow, ograniczenia mogą wynikać z dostępności regionów (Paperspace nie posiada tylu centrów danych co AWS czy Azure) oraz mniejszej liczby zaawansowanych opcji sieciowych.

- Korzyści: szybki dostęp do wydajnych GPU (H100, A100, RTX 6000), prostota wdrożeń, elastyczny model kosztowy, gotowe narzędzia AI/ML, integracje z CI/CD i DevOps, szybka skalowalność, przejrzysty billing.

- Możliwość pracy w zespołach, łatwe przydzielanie zasobów członkom projektu, wsparcie dla Docker, Jupyter, API do automatyzacji wdrożeń.

- Dostępność darmowych warstw (free tier) i rabatów przy większych wolumenach, co ułatwia testowanie i optymalizację budżetu.

- Ograniczenia: mniej regionów i centrów danych niż u liderów rynku, ograniczone opcje zaawansowanej sieci i compliance, czasami dłuższy czas oczekiwania na dostęp do topowych GPU przy dużym popycie.

- Brak bardzo zaawansowanych usług zarządzanych (np. zaawansowane AI pipelines, własne VPC), ograniczenia przy pracy z poufnymi danymi (brak certyfikacji typu HIPAA czy ISO dla wszystkich regionów).

Z punktu widzenia firmy, Paperspace to rozwiązanie dla zespołów, które potrzebują szybkiego startu w AI/ML, elastycznych modeli kosztowych i prostoty obsługi, ale nie zawsze sprawdzi się tam, gdzie wymagane są zaawansowane opcje bezpieczeństwa lub pełna kontrola nad infrastrukturą.

Jak optymalizować koszty i zarządzać zasobami GPU na Paperspace?

Refleksja: Czy Paperspace to dobra inwestycja dla polskich firm w 2026 roku?

Decyzja o wdrożeniu Paperspace w polskim biznesie w 2026 roku to nie tylko kwestia wygody dostępu do GPU, ale też strategiczny wybór, który realnie wpływa na tempo rozwoju produktów i przewagę konkurencyjną. Dla startupów AI, software house’ów czy firm z branży healthtech, możliwość uruchamiania eksperymentów na A100 lub H100 bez inwestycji w fizyczny sprzęt oznacza skrócenie time-to-market nawet o kilka miesięcy. Z drugiej strony, firmy z ustabilizowaną infrastrukturą mogą postrzegać koszt rozliczany za godzinę jako mniej przewidywalny niż własne serwerownie lub długoterminowe kontrakty w AWS.

W praktyce Paperspace przyciąga głównie zespoły, które pracują z TensorFlow, PyTorch czy JAX i chcą testować modele bez ograniczeń sprzętowych. W rozmowach z founderami słyszę często: „Potrzebuję uruchomić 10 eksperymentów jednocześnie, nie czekając w kolejce na wolnego GPU”. Dla takich zespołów elastyczność Paperspace może być nieoceniona, zwłaszcza jeśli liczy się szybki feedback i iteracyjny rozwój. Z drugiej strony, dla firm stawiających na compliance lub mających bardzo restrykcyjne wymogi dot. lokalizacji danych, Paperspace może być mniej atrakcyjny niż lokalni dostawcy chmury z centrami danych w Polsce.

Warto zwrócić uwagę, że polski rynek IT w 2026 roku coraz śmielej inwestuje w AI/ML, a dostępność tanich i wydajnych GPU jest wciąż ograniczona. Paperspace rozwiązuje ten problem, ale wymaga świadomego podejścia do zarządzania kosztami i optymalizacji workflowów. Przykładowo, przy dłuższych treningach modeli deep learning, różnica kosztów między Paperspace a modelem rezerwacyjnym w Google Cloud potrafi wynosić nawet 20-30% miesięcznie, co dla dużych projektów przekłada się na dziesiątki tysięcy złotych. To właśnie te niuanse decydują o tym, czy Paperspace jest inwestycją, czy tylko narzędziem „na próbę”.

Moja osobista obserwacja: polskie firmy coraz częściej traktują Paperspace jako sposób na szybkie testy MVP, hackathony czy projekty pilotażowe, a dopiero po walidacji produktu przenoszą część obciążeń do większych chmur lub własnych serwerowni. To podejście pozwala minimalizować ryzyko inwestycyjne i lepiej skalować koszty. Jak powiedział niedawno CTO jednej z warszawskich firm AI, „Paperspace daje nam przewagę w sprintach – nie budujemy infrastruktury, tylko skupiamy się na modelu”. To sedno przewagi tej platformy w polskich realiach biznesowych.

Podsumowanie

Paperspace to nowoczesna platforma chmurowa, która pozwala firmom i zespołom programistycznym w Polsce szybko uruchamiać projekty AI i machine learning z dostępem do zaawansowanych GPU. W artykule wyjaśniam, jak w praktyce działa Paperspace, jakie oferuje funkcje (Gradient, Core, API) i czym różni się od gigantów jak AWS czy Google Cloud. Pokazuję też, jak krok po kroku wystartować z projektem, jak skutecznie zarządzać kosztami oraz dla kogo ta platforma jest realnie opłacalna w 2026 roku. To przewodnik dla tych, którzy chcą efektywnie wykorzystać chmurę GPU w swoim biznesie!

Najczesciej zadawane pytania

Czy Paperspace umożliwia korzystanie z własnych obrazów systemu operacyjnego lub środowisk programistycznych?

Jak wygląda wsparcie techniczne na Paperspace i czy jest dostępne w języku polskim?

Czy Paperspace umożliwia integrację z narzędziami do monitoringu i logowania, takimi jak Prometheus lub Datadog?

Jak Paperspace radzi sobie z aktualizacjami bezpieczeństwa i ochroną przed atakami?

Czy można automatycznie skalować zasoby GPU na Paperspace w odpowiedzi na obciążenie projektu?