Sieci neuronowe nie są już tylko domeną naukowców z laboratoriów – w 2026 roku napędzają nowoczesne technologie i rewolucjonizują innowacyjne rozwiązania w biznesie, medycynie, a nawet sztuce. Dlaczego ta koncepcja, inspirowana ludzkim mózgiem, tak skutecznie przełożyła się na cyfrową rzeczywistość? W tym artykule zagłębimy się w biologiczne inspiracje i cyfrową ewolucję sieci neuronowych, odkryjemy ich architekturę, rodzaje oraz wiodące algorytmy uczenia. Przeanalizujemy konkretne wdrożenia z 2026 roku, sprawdzimy najnowsze narzędzia, a także spojrzymy na nietypowe zastosowania i aktualne dylematy etyczne związane z rozwojem tej technologii.

📋Na skróty

Sieci neuronowe: biologiczne inspiracje i cyfrowa ewolucja

Architektura i warstwy: jak zbudowane są współczesne sieci neuronowe

Rodzaje sieci neuronowych i ich praktyczne zastosowania

Algorytmy uczenia sieci neuronowych – od perceptronu do głębokiego uczenia

Zastosowania sieci neuronowych w biznesie: przykłady wdrożeń z 2026 roku

Narzędzia i biblioteki do pracy z sieciami neuronowymi – przegląd na 2026 rok

Ciekawostka: sieci neuronowe poza IT – nietypowe zastosowania w 2026 roku

Wybrane wyzwania i dylematy etyczne w rozwoju sieci neuronowych

Kluczowe wnioski

- Sieci neuronowe, inspirowane strukturą ludzkiego mózgu, są dziś fundamentem nowoczesnych technologii – ich warstwowa architektura umożliwia rozwiązywanie złożonych problemów biznesowych.

- W 2026 roku dostępne są różnorodne rodzaje sieci neuronowych (m.in. CNN, RNN, transformers), które sprawdzają się w zadaniach od rozpoznawania obrazów po analizę języka naturalnego czy sterowanie robotami.

- Wdrażanie sieci neuronowych w biznesie wymaga wyboru odpowiednich narzędzi i bibliotek – liderami pozostają TensorFlow i PyTorch, ale na rynku pojawiają się także specjalistyczne rozwiązania open-source, ułatwiające prototypowanie i skalowanie projektów.

- Praktyczne wykorzystanie sieci neuronowych przynosi konkretne korzyści: automatyzacja procesów, lepsze prognozowanie, personalizacja oferty oraz nowe modele biznesowe – firmy z różnych sektorów już wykorzystują te możliwości w codziennej działalności.

- Rozwój sieci neuronowych rodzi wyzwania etyczne i społeczne – transparentność działania, eliminacja uprzedzeń w danych oraz bezpieczeństwo wdrożeń są obecnie kluczowymi tematami dla decydentów i zespołów projektowych.

Sieci neuronowe: biologiczne inspiracje i cyfrowa ewolucja

Inspiracje biologiczne nie są przypadkowe – ludzki mózg składa się z około 86 miliardów neuronów, z których każdy może tworzyć tysiące połączeń. W cyfrowych odpowiednikach, takich jak sieci głębokie (deep neural networks), architektura warstw i węzłów pozwala na przetwarzanie ogromnych zbiorów danych i wyciąganie wzorców, które byłyby niewidoczne dla tradycyjnych algorytmów. Przełożenie mechanizmów uczenia się z biologii na język kodu otworzyło drzwi do eksploracji danych na niespotykaną wcześniej skalę – co widać również w kreatywnych zastosowaniach, takich jak sztuczna inteligencja w muzyce.

Dla biznesu i nauki przełomowe było zrozumienie, że sieci neuronowe nie tylko klasyfikują dane, ale potrafią rozpoznawać złożone zależności, przewidywać trendy i automatycznie dostosowywać się do nowych informacji. Przykładem są systemy rekomendacyjne Netflixa czy personalizowane reklamy Google, które wykorzystują wielowarstwowe sieci neuronowe do analizy setek milionów interakcji użytkowników dziennie. W 2026 roku, dzięki rozwojowi architektur takich jak transformers, możliwe stało się przetwarzanie języka naturalnego na poziomie zbliżonym do ludzkiego rozumienia.

Ewolucja cyfrowa sieci neuronowych to nie tylko wzrost ich złożoności, ale także dostępność. Dzięki narzędziom open-source, takim jak TensorFlow, PyTorch czy Keras, nawet małe zespoły mogą projektować własne modele i trenować je na skalowalnej infrastrukturze chmurowej. To przekłada się na realne korzyści dla firm: automatyzację procesów, lepsze prognozowanie popytu czy szybsze wykrywanie oszustw finansowych. W praktyce, sieci neuronowe stały się mostem między inspiracją biologiczną a cyfrową innowacją, umożliwiając rozwój produktów, które jeszcze dekadę temu byłyby uznane za science fiction.

Architektura i warstwy: jak zbudowane są współczesne sieci neuronowe

W praktyce każda sieć neuronowa składa się z minimum trzech typów warstw: wejściowej, ukrytych oraz wyjściowej. Liczba i rodzaj warstw determinują możliwości modelu – przykładowo, sieci głębokie (deep neural networks) mogą mieć nawet kilkaset warstw, co pozwala im na hierarchiczne uczenie się złożonych wzorców. W 2026 roku standardem są architektury takie jak ResNet (ponad 100 warstw), EfficientNet czy sieci typu transformer (np. GPT-4, BERT), które wykorzystują zaawansowane mechanizmy jak warstwy uwagi (attention layers) i normalizacji (LayerNorm).

Warto wiedzieć, że każda warstwa pełni w sieci określoną funkcję – od wstępnej obróbki sygnału po finalną klasyfikację lub generowanie. Dla np. zespołu analitycznego w banku warstwa konwolucyjna pozwala wykryć podejrzane wzorce w danych transakcyjnych, a dla startupu z branży medycznej – warstwa rekurencyjna może analizować sekwencje badań pacjenta. Architektura sieci powinna być dobierana do specyfiki problemu: inne warstwy sprawdzą się przy analizie obrazu, inne przy przetwarzaniu tekstu czy dźwięku.

Lista głównych typów warstw spotykanych w sieciach neuronowych:

- Warstwa wejściowa – odbiera dane (np. piksele obrazu, liczby, tekst) i przekazuje je dalej.

- Warstwa ukryta – przetwarza i transformuje dane, ucząc się złożonych reprezentacji; może być ich wiele.

- Warstwa wyjściowa – generuje wynik sieci, np. klasyfikację lub prognozę liczbową.

- Warstwa konwolucyjna (CNN) – wydobywa lokalne wzorce z danych, szczególnie użyteczna w analizie obrazów.

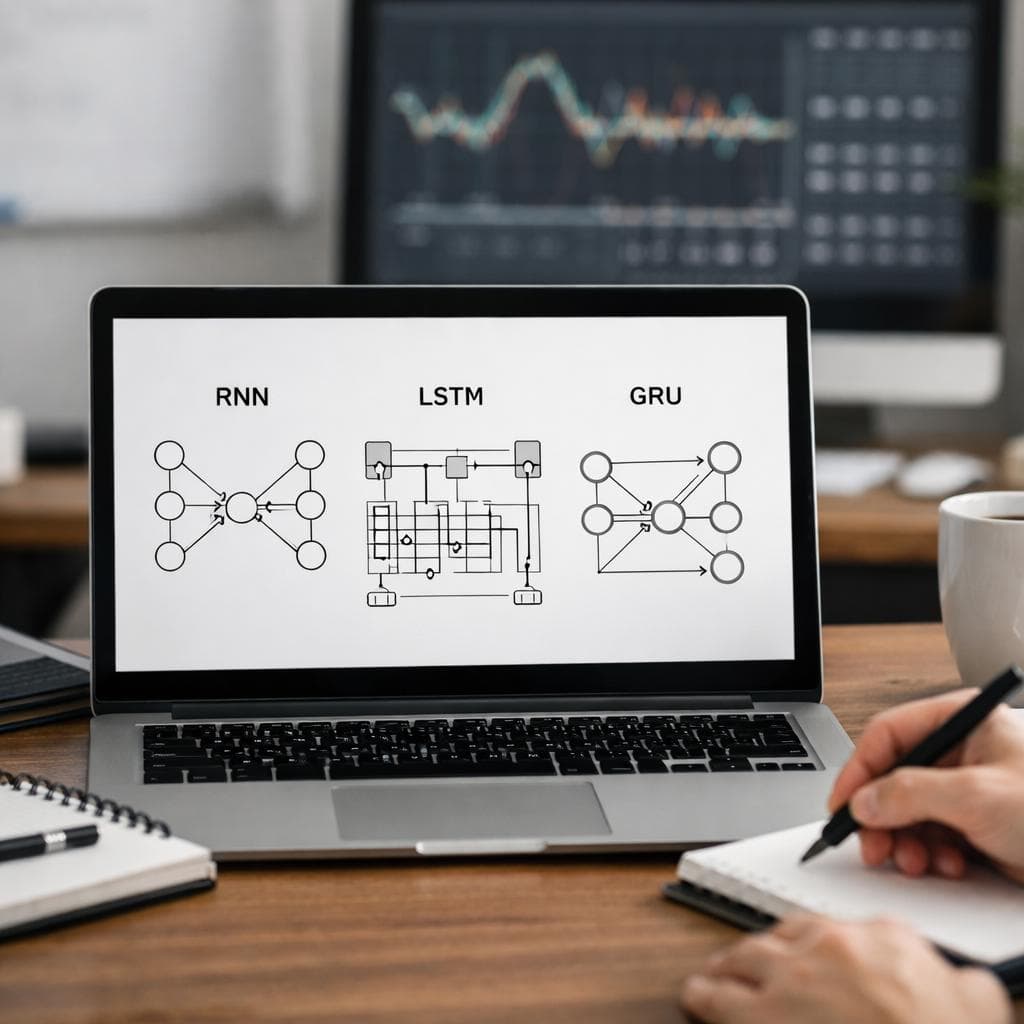

- Warstwa rekurencyjna (RNN, LSTM, GRU) – przetwarza dane sekwencyjne, takie jak tekst czy sygnały czasowe.

- Warstwa normalizująca (BatchNorm, LayerNorm) – stabilizuje i przyspiesza uczenie poprzez normalizację danych w trakcie treningu.

- Warstwa uwagi (attention) – pozwala sieci skupić się na najistotniejszych fragmentach danych wejściowych.

Współczesne frameworki, takie jak TensorFlow, PyTorch czy Keras, oferują gotowe narzędzia do budowania i eksperymentowania z różnymi układami warstw. Pozwala to zarówno programistom, jak i zespołom biznesowym prototypować i wdrażać nowoczesne modele bez konieczności tworzenia wszystkiego od podstaw. Z punktu widzenia firmy odpowiedni dobór architektury i typów warstw decyduje o skuteczności wdrożenia AI w realnym środowisku biznesowym.

Rodzaje sieci neuronowych i ich praktyczne zastosowania

Spektrum architektur: od prostych po zaawansowane rozwiązania

Współczesne sieci neuronowe to nie tylko jedna technologia, lecz cały ekosystem architektur, które odpowiadają na bardzo różne potrzeby biznesowe i technologiczne. Prosta sieć wielowarstwowa (MLP) sprawdzi się przy analizie danych tabelarycznych, podczas gdy konwolucyjne sieci neuronowe (CNN) dominują w zadaniach związanych z rozpoznawaniem obrazu. Dla firm budujących systemy rozpoznawania mowy lub przetwarzania języka naturalnego, fundamentem są sieci rekurencyjne (RNN) i ich nowoczesne warianty, takie jak LSTM czy GRU. Najnowszym trendem są architektury transformers, które już dziś napędzają narzędzia generatywne i zaawansowane chatboty, znacząco przyspieszając automatyzację obsługi klienta oraz analizę dużych zbiorów tekstów.Wpływ na biznes: konkretne scenariusze wykorzystania

W 2026 roku wybór typu sieci neuronowej decyduje o skuteczności wdrożenia w praktyce. CNN pozwalają firmom e-commerce błyskawicznie klasyfikować miliony zdjęć produktów, a sieci rekurencyjne umożliwiają bankom analizę sekwencji transakcji pod kątem wykrywania nadużyć. Transformers zrewolucjonizowały narzędzia tłumaczeniowe, analitykę opinii czy systemy rekomendacyjne. W logistyce sieci neuronowe pomagają prognozować popyt i optymalizować trasy dostaw, a w medycynie wspierają analizę obrazów radiologicznych. Każda architektura ma swoje mocne strony – wybór zależy od specyfiki problemu i dostępnych danych.Porównanie architektur: tabela zalet, ograniczeń i zastosowań

| Typ sieci | Zalety | Ograniczenia | Przykładowe zastosowania |

|---|---|---|---|

| MLP | Uniwersalność, prostota implementacji | Słaba wydajność przy danych sekwencyjnych i obrazowych | Analiza danych tabelarycznych, podstawowa klasyfikacja |

| CNN | Wysoka skuteczność w analizie obrazów | Duże zapotrzebowanie na moc obliczeniową | Rozpoznawanie obrazów, diagnostyka medyczna, rozpoznawanie twarzy |

| RNN (LSTM, GRU) | Efektywność w analizie sekwencji i danych czasowych | Trudności z uczeniem długich zależności | Przetwarzanie tekstu, rozpoznawanie mowy, analiza szeregów czasowych |

| Transformers | Bardzo dobra skalowalność i wydajność przy dużych zbiorach danych | Wysokie wymagania sprzętowe, złożoność architektury | Generowanie tekstu, tłumaczenia maszynowe, systemy rekomendacyjne |

Algorytmy uczenia sieci neuronowych – od perceptronu do głębokiego uczenia

Jak uczą się sieci neuronowe – fundamenty i praktyczne znaczenie

Algorytmy uczenia są sercem każdej sieci neuronowej – to właśnie one decydują, czy model będzie w stanie rozpoznawać obrazy, analizować tekst czy przewidywać trendy rynkowe. Dla przedsiębiorców oznacza to możliwość automatyzacji procesów, dla naukowców – narzędzie do odkrywania wzorców w złożonych danych, a dla twórców oprogramowania – pole do eksperymentów z nowymi architekturami. W 2026 roku efektywność algorytmów przekłada się bezpośrednio na koszty obliczeniowe i czas wdrożenia produktu. W praktyce wybór odpowiedniego algorytmu determinuje nie tylko jakość wyników, ale również skalowalność rozwiązania i możliwość adaptacji do zmieniających się danych.Od perceptronu do deep learningu – ewolucja algorytmów

Pierwsze sieci uczyły się na bazie prostych reguł, jak perceptron Rosenblatta, który rozwiązywał zadania liniowo separowalne. Prawdziwy przełom przyniosło opracowanie algorytmu backpropagation w latach 80., umożliwiającego trenowanie wielu warstw – to otworzyło drogę do głębokiego uczenia (deep learning). Dziś, dzięki optymalizatorom takim jak Adam czy RMSprop, modele można trenować szybciej i na większych zbiorach danych. Współczesne frameworki jak TensorFlow, PyTorch czy JAX pozwalają na eksperymentowanie z różnymi algorytmami praktycznie „od ręki”, co przyspiesza wdrożenia w biznesie i nauce.- Backpropagation – algorytm wstecznej propagacji błędu, umożliwia uczenie wielu warstw poprzez aktualizację wag na podstawie błędu końcowego.

- Stochastic Gradient Descent (SGD) – metoda optymalizacji polegająca na aktualizacji wag po każdej próbce lub mini-partii danych, przyspiesza proces uczenia dużych zbiorów.

- Adam (Adaptive Moment Estimation) – łączy zalety Adagrad i RMSprop, automatycznie dostosowuje szybkość uczenia do każdego parametru, często wybierany w praktyce ze względu na stabilność.

- RMSprop – utrzymuje osobną szybkość uczenia dla każdego parametru, dobrze sprawdza się w sieciach rekurencyjnych i zadaniach z nierównomiernie rozłożonymi gradientami.

Wyzwania i kierunki rozwoju w uczeniu sieci neuronowych

W 2026 roku największe wyzwania dotyczą nie tylko precyzji, ale także efektywności energetycznej i przejrzystości działania algorytmów. Modele deep learningu, choć potężne, wymagają dużych mocy obliczeniowych – to rodzi pytania o zrównoważony rozwój i wpływ na środowisko. Coraz większe znaczenie ma też explainable AI: firmy chcą rozumieć, jak i dlaczego sieć podejmuje konkretne decyzje. Narzędzia takie jak Captum (dla PyTorch) czy interpretML pomagają analizować proces uczenia, a nowe algorytmy, np. federated learning czy transfer learning, umożliwiają trenowanie modeli bez konieczności gromadzenia wszystkich danych w jednym miejscu. Dla biznesu oznacza to większą elastyczność i bezpieczeństwo wdrożeń.Zastosowania sieci neuronowych w biznesie: przykłady wdrożeń z 2026 roku

W 2026 roku sieci neuronowe znalazły się w centrum transformacji cyfrowej przedsiębiorstw, niezależnie od branży i skali działania. O ich znaczeniu decyduje zdolność do automatycznego przetwarzania ogromnych wolumenów danych, wykrywania wzorców i przewidywania trendów szybciej niż tradycyjne algorytmy. Dla właścicieli firm, managerów czy zespołów IT wdrożenie rozwiązań opartych o sieci neuronowe oznacza wymierne oszczędności, poprawę efektywności operacyjnej oraz nowe możliwości monetyzacji danych. Szczególnie cenią je organizacje, które muszą podejmować szybkie decyzje na podstawie nieustrukturyzowanych danych – jak banki, sklepy internetowe czy firmy logistyczne.

- Automatyzacja obsługi klienta – chatboty i voiceboty napędzane przez modele konwersacyjne (np. ChatGPT-4, Gemini) obsługują już ponad 60% wszystkich zapytań w dużych sieciach retail w Polsce.

- Personalizacja ofert i marketingu – silniki rekomendacyjne (TensorFlow, PyTorch) analizują historię zakupów, prognozując, które produkty zareklamować konkretnemu użytkownikowi, co zwiększa konwersję nawet o 35%.

- Wykrywanie oszustw finansowych – sieci neuronowe identyfikują anomalie w transakcjach w czasie rzeczywistym, ograniczając straty banków związane z fraudami o kilkadziesiąt milionów złotych rocznie.

- Analiza sentymentu i opinii – narzędzia takie jak BERT i RoBERTa analizują setki tysięcy recenzji, pomagając markom szybciej reagować na kryzysy wizerunkowe.

- Predykcja popytu i optymalizacja łańcucha dostaw – firmy korzystają z deep learningu do przewidywania zapotrzebowania na produkty, co pozwala zmniejszyć stany magazynowe nawet o 20%.

- Automatyczna klasyfikacja dokumentów – rozwiązania OCR oparte o sieci konwolucyjne (np. Keras, OpenCV) usprawniają procesy księgowe i administracyjne w dużych korporacjach.

- Diagnostyka medyczna – sieci neuronowe analizują obrazy RTG i MRI, wspierając lekarzy w rozpoznawaniu zmian chorobowych szybciej i skuteczniej niż tradycyjne metody.

- Monitorowanie i predykcja awarii maszyn – modele predykcyjne wdrażane w przemyśle (np. Siemens MindSphere) pozwalają zredukować przestoje produkcyjne o kilkanaście procent.

- Tworzenie treści generatywnych – firmy mediowe i marketingowe korzystają z generatywnych sieci neuronowych do produkcji tekstów, grafik czy muzyki, skracając czas realizacji kampanii.

Wdrażanie sieci neuronowych w 2026 roku nie ogranicza się już do korporacji z własnym działem R&D – API popularnych serwisów (np. Google AI, Microsoft Azure Cognitive Services) oraz gotowe frameworki umożliwiają szybkie prototypowanie i skalowanie rozwiązań nawet w średnich firmach. Z perspektywy biznesowej to nie tylko przewaga technologiczna, ale sposób na zwiększenie zysków, lepsze zarządzanie ryzykiem i sprawniejsze reagowanie na zmiany rynkowe.

Narzędzia i biblioteki do pracy z sieciami neuronowymi – przegląd na 2026 rok

| Biblioteka | Popularność (2026) | Wsparcie społeczności | Łatwość użycia | Typowe zastosowania |

|---|---|---|---|---|

| TensorFlow | Wysoka | Bardzo duże | Średnia | Produkcja, chmura, mobile |

| PyTorch | Bardzo wysoka | Ogromne | Wysoka | Badania, prototypy, NLP |

| JAX | Rośnie | Średnie | Średnia | Eksperymenty, optymalizacja |

| Keras | Stabilna | Duże | Bardzo wysoka | Edukacja, szybkie prototypy |

| MXNet | Nisza | Średnie | Średnia | Chmura, IoT, produkcja |

Ciekawostka: sieci neuronowe poza IT – nietypowe zastosowania w 2026 roku

Sieci neuronowe w 2026 roku wykraczają daleko poza granice IT, przenikając do dziedzin, które jeszcze kilka lat temu wydawały się odporne na cyfrową rewolucję. Coraz częściej spotykamy ich zastosowania w rolnictwie precyzyjnym, gdzie analizują wzorce wzrostu roślin na podstawie zdjęć satelitarnych i czujników IoT. Przykładowo, platforma AgroSense wykorzystuje głębokie sieci konwolucyjne do przewidywania rozwoju chorób upraw, co pozwala rolnikom ograniczyć zużycie pestycydów nawet o 30%. To realna zmiana nie tylko dla dużych gospodarstw, ale i dla mniejszych producentów, którzy mogą konkurować elastycznością i jakością.

W 2026 roku sieci neuronowe wspierają także twórców muzyki i sztuki wizualnej. Narzędzia takie jak Amper Music czy DALL·E 4 umożliwiają generowanie oryginalnych utworów oraz obrazów na żądanie, dostosowanych do nastroju lub określonego stylu. Kompozytorzy korzystają z modeli językowych do budowania harmonii, a malarze eksperymentują z algorytmami, które analizują trendy i sugerują kierunki twórczości. To nie jest już tylko zabawa – na aukcjach Christie’s w 2025 roku obraz wygenerowany przez sieć GAN sprzedał się za 1,2 mln dolarów.

Nietypowym, ale coraz popularniejszym obszarem są także badania nad zdrowiem psychicznym i terapią. Startup MindMosaic z Berlina wdrożył sieci rekurencyjne do analizy dzienników emocji i głosu pacjentów, pomagając psychoterapeutom szybciej identyfikować symptomy depresji czy lęku. Dla lekarzy to narzędzie, które nie tylko wspiera diagnozę, ale i pozwala prowadzić terapię z większą uważnością na indywidualne potrzeby.

Ostatnio miałam okazję rozmawiać z bioinżynierem, który porównał rozwój sieci neuronowych do „nowej elektryczności” – energii napędzającej zmiany tam, gdzie dotąd rządziła intuicja lub doświadczenie. Jego słowa dobrze oddają skalę tej cichej rewolucji. To, co kiedyś uchodziło za domenę programistów, dziś staje się narzędziem dla artystów, rolników czy terapeutów. Z punktu widzenia firmy czy instytucji, otwarcie się na nietypowe zastosowania sieci neuronowych może przynieść przewagę konkurencyjną, której nie da się łatwo podrobić.

Wybrane wyzwania i dylematy etyczne w rozwoju sieci neuronowych

Przejrzystość i zaufanie do modeli

Jednym z największych wyzwań dla firm wdrażających sieci neuronowe jest brak przejrzystości działania tych systemów. Modele, zwłaszcza głębokie sieci, potrafią generować trafne rekomendacje czy diagnozy, ale ich proces decyzyjny często pozostaje czarną skrzynką. Przykład: w 2026 roku aż 68% liderów IT w Europie Zachodniej przyznało, że trudności z wyjaśnianiem decyzji AI ograniczają skalowanie projektów w sektorze finansowym i medycznym. Dla instytucji publicznych i branż regulowanych to realny problem – zaufanie użytkowników i zgodność z przepisami (np. AI Act w UE) zależy od możliwości audytowania i interpretacji wyników.Uprzedzenia danych i sprawiedliwość algorytmiczna

Sieci neuronowe, ucząc się na ogromnych zbiorach danych, mogą nieświadomie utrwalać istniejące w społeczeństwie uprzedzenia. Przykłady z ostatnich lat pokazują, że modele rozpoznawania twarzy (np. wykorzystywane w systemach monitoringu publicznego) osiągają nawet o 20% niższą skuteczność dla osób o ciemniejszej karnacji. Z punktu widzenia biznesu takie błędy wiążą się nie tylko z ryzykiem wizerunkowym, ale i prawnym – w 2025 roku Amazon musiał wycofać narzędzie rekrutacyjne oparte na AI, gdy okazało się, że faworyzuje kandydatów płci męskiej. Dlatego coraz więcej organizacji inwestuje w narzędzia do audytu etycznego (np. IBM AI Fairness 360, Microsoft Fairlearn), by ograniczyć ryzyka i chronić reputację.Bezpieczeństwo i odpowiedzialność

Wraz z rozwojem sieci neuronowych rośnie zagrożenie nadużyć – od generowania fałszywych treści (deepfake) po ataki typu adversarial, w których drobne zmiany w danych wejściowych prowadzą do błędnych decyzji AI. W 2026 roku ponad 30% firm z branży e-commerce deklaruje, że bezpieczeństwo modeli AI to jeden z głównych priorytetów inwestycyjnych, szczególnie w kontekście ochrony danych klientów i zapobiegania manipulacjom. Odpowiedzialność za skutki działania sieci neuronowych staje się tematem debat prawnych – pojawiają się pytania, kto odpowiada za błędy: twórca modelu, dostawca danych czy użytkownik końcowy. Przedsiębiorstwa muszą dziś nie tylko wdrażać techniczne zabezpieczenia, ale także budować strategie zarządzania ryzykiem i transparentnej komunikacji z interesariuszami.Podsumowanie

Sieci neuronowe w 2026 roku to nie tylko inspiracja ludzkim mózgiem, ale serce nowoczesnych technologii – od automatyzacji procesów biznesowych po kreatywne rozwiązania w sztuce. Artykuł pokazuje, jak warstwowa architektura oraz różnorodność typów sieci przekładają się na praktyczne korzyści dla firm i startupów. Poznasz przykłady wdrożeń, trendy, narzędzia (Python, TensorFlow, PyTorch) oraz wyzwania etyczne, z którymi mierzą się projektanci AI. Tekst obala mity, tłumaczy mechanizmy uczenia i zachęca do eksperymentowania z sztuczną inteligencją – także poza branżą IT. To przewodnik po świecie sieci neuronowych, gdzie technologia spotyka realne potrzeby biznesu.

Najczesciej zadawane pytania

Czy do wdrożenia sieci neuronowych w firmie potrzebne są specjalistyczne kompetencje?

Jak długo trwa szkolenie (trening) sieci neuronowej na dużych zbiorach danych?

Czy sieci neuronowe są odporne na błędy i ataki cybernetyczne?

Jakie są koszty wdrożenia sieci neuronowych w małej firmie?

Czy sieci neuronowe mogą działać na urządzeniach mobilnych lub IoT?