Transfer learning, czyli uczenie transferowe, to przełomowe podejście, które radykalnie skraca czas i koszty wdrożenia AI w biznesie. Zamiast zaczynać od zera, firmy mogą wykorzystać istniejące modele i dostosować je do własnych potrzeb – to realna przewaga w 2026 roku. W tym artykule odkryjesz, jak działa transfer learning w praktyce, poznasz jego różne rodzaje, porównasz go z fine-tuningiem oraz zobaczysz, kiedy takie podejście daje największe korzyści. Analizujemy zalety i ograniczenia, wyzwania implementacyjne, wybór frameworków i praktyczne scenariusze użycia, które zmieniają reguły gry w świecie sztucznej inteligencji.

📋Na skróty

Transfer learning – definicja i podstawy teoretyczne

Rodzaje transfer learningu i ich praktyczne znaczenie

Transfer learning vs. fine-tuning – porównanie podejść

Zalety i ograniczenia transfer learningu w kontekście biznesowym

Praktyczne zastosowania transfer learningu – przykłady 2026

Wyzwania i pułapki transfer learningu – czego unikać w praktyce

Frameworki i narzędzia do transfer learningu – przegląd i porównanie

Refleksja eksperta: Jak transfer learning zmienia realia wdrożeń AI w 2026 roku?

Kluczowe wnioski

- Transfer learning pozwala firmom wdrażać AI szybciej i taniej, wykorzystując gotowe modele zamiast budować je od podstaw.

- Wybór odpowiedniego rodzaju uczenia transferowego zależy od dostępności danych i specyfiki problemu – nie każde rozwiązanie sprawdzi się w każdym biznesie.

- Fine-tuning i transfer learning to różne podejścia – fine-tuning wymaga więcej dostosowań, ale daje lepsze wyniki przy dużych różnicach między zadaniami.

- Największe pułapki to negatywny transfer i niezgodność domen – kluczowe jest testowanie i ostrożność przy wyborze modelu bazowego.

- W 2026 roku liderami w transfer learningu są frameworki PyTorch, TensorFlow i Keras, które oferują gotowe narzędzia do szybkiego wdrażania AI w biznesie.

Transfer learning – definicja i podstawy teoretyczne

Jeszcze dekadę temu większość projektów AI wymagała budowania modeli od zera, co pochłaniało ogromne zasoby i czas. Transfer learning (uczenie transferowe) całkowicie zmienił zasady gry – pozwala wykorzystać wiedzę już wytrenowaną na dużych zbiorach danych i przenieść ją do nowych zadań, nawet jeśli dostępnych danych jest niewiele. Dla firm oznacza to nie tylko szybsze wdrożenia, ale też dostęp do możliwości, które wcześniej były poza zasięgiem z powodu ograniczeń budżetowych lub technicznych.

Z technicznego punktu widzenia, transfer learning polega na ponownym użyciu fragmentów (np. warstw) modelu wytrenowanego na jednym zadaniu, aby rozwiązać inne, często pokrewne zadanie. Klasycznym przykładem jest wykorzystanie modeli wizji komputerowej, takich jak ResNet czy EfficientNet, które zostały wytrenowane na ImageNet (zbiorze ponad 14 mln obrazów) i mogą być dostosowane do specyficznych potrzeb – np. rozpoznawania wad produkcyjnych w fabryce czy analizy zdjęć medycznych. W NLP z kolei przełomem były modele typu BERT czy GPT, które wyznaczyły nowe standardy w analizie tekstu. Coraz częściej do realizacji takich zadań wykorzystuje się również platformy chmurowe, takie jak Paperspace, które umożliwiają szybkie wdrażanie i testowanie modeli transfer learningu bez konieczności inwestowania w zaawansowaną infrastrukturę lokalną.

W praktyce transfer learning skraca czas trenowania modeli nawet o 70–90%, a także radykalnie zmniejsza zapotrzebowanie na dane – w niektórych zastosowaniach wystarczy już kilkaset próbek, by osiągnąć satysfakcjonujące wyniki. To otwiera drzwi do AI dla mniejszych firm i startupów, które nie mają dostępu do milionowych zbiorów danych. Co ciekawe, badania z 2025 roku przeprowadzone przez Google Research pokazują, że skuteczność transfer learningu rośnie wraz z różnorodnością danych źródłowych, a nie tylko ich liczbą.

Jako ekspert obserwuję, jak transfer learning zmienia podejście do wdrażania AI – nie tylko przyspiesza rozwój, ale też pozwala uniknąć błędów typowych dla „czystego” uczenia od zera. Jedno z moich ulubionych spostrzeżeń pochodzi od Yann LeCuna, laureata Nagrody Turinga: „Większość tego, czego się uczymy, pochodzi z wcześniejszych doświadczeń – maszyny nie powinny być wyjątkiem”. To zdanie świetnie oddaje istotę transfer learningu w 2026 roku – praktyczne czerpanie z istniejącej wiedzy, zamiast ciągłego wymyślania koła na nowo.

Rodzaje transfer learningu i ich praktyczne znaczenie

Dlaczego rozróżnienie rodzajów transfer learningu ma znaczenie w biznesie?

Zastosowanie transfer learningu zależy od charakteru problemu, dostępności danych oraz oczekiwanych rezultatów. W praktyce firmy decydują się na konkretny typ transfer learningu, aby zoptymalizować koszty i skrócić czas wdrożenia modeli AI. Wybór odpowiedniego podejścia wpływa na precyzję, szybkość adaptacji oraz ryzyko tzw. negatywnego transferu, czyli pogorszenia wyników przez nieodpowiednie przeniesienie wiedzy. Przykłady z branży medycznej czy e-commerce pokazują, że właściwy dobór strategii transferu umożliwia skuteczne wykorzystanie nawet ograniczonych zbiorów danych, co realnie przekłada się na przewagę konkurencyjną. W kontekście przetwarzania języka naturalnego warto zwrócić uwagę na rozwiązania takie jak BERT pozycjonowanie, które ilustrują praktyczne zastosowanie transfer learningu w SEO i analizie tekstu.- Inductive Transfer Learning – model uczy się na jednej dziedzinie (źródłowej), a następnie jest dostosowywany do innej dziedziny (docelowej), gdzie dostępne są etykiety. Typowe dla rozpoznawania obrazów, np. adaptacja sieci ResNet z ImageNet do analizy zdjęć medycznych.

- Transductive Transfer Learning – model uczy się na danych źródłowych, ale w dziedzinie docelowej nie ma etykiet. Często stosowany w przetwarzaniu języka naturalnego, np. przenoszenie modeli analizy sentymentu między różnymi językami.

- Unsupervised Transfer Learning – żadne z danych (źródłowych ani docelowych) nie posiadają etykiet. Używany w rekomendacjach lub segmentacji klientów, gdy konieczna jest identyfikacja wzorców bez nadzoru.

Różnice w podejściu: kiedy użyć konkretnego typu transfer learningu?

Inductive transfer learning sprawdza się, gdy w nowej dziedzinie mamy choć niewielką liczbę oznaczonych przykładów. Przykład: startupy analizujące obrazy satelitarne mogą wykorzystać gotowe modele wytrenowane na zdjęciach lotniczych, dostosowując je do własnych danych. Transductive transfer learning jest praktyczny, jeśli etykietowanie danych docelowych jest niemożliwe lub kosztowne – np. w analizie opinii klientów w nowym języku, gdzie brak gotowych słowników. Unsupervised transfer learning to rozwiązanie dla firm, które chcą odkrywać nieznane wzorce w danych bez ręcznego oznaczania, np. w detekcji anomalii czy wykrywaniu nadużyć finansowych.Praktyczne wyzwania i wybór narzędzi

Wdrożenie transfer learningu wymaga nie tylko wyboru odpowiedniego typu, ale też technologii. Najczęściej wykorzystywane frameworki to TensorFlow, PyTorch oraz Keras, które oferują gotowe modele do transferu, np. BERT do NLP czy EfficientNet do wizji komputerowej. Problemem może być tzw. negative transfer – przeniesienie wiedzy z nieodpowiedniej dziedziny skutkujące spadkiem efektywności. Firmy muszą też zwracać uwagę na zgodność licencyjną modeli oraz potencjalne ryzyka związane z biasem danych źródłowych. W praktyce, skuteczne wdrożenie transfer learningu wymaga iteracyjnego testowania oraz kontroli jakości wyników na rzeczywistych danych biznesowych.Transfer learning vs. fine-tuning – porównanie podejść

Dlaczego rozróżnienie ma znaczenie w praktyce biznesowej?

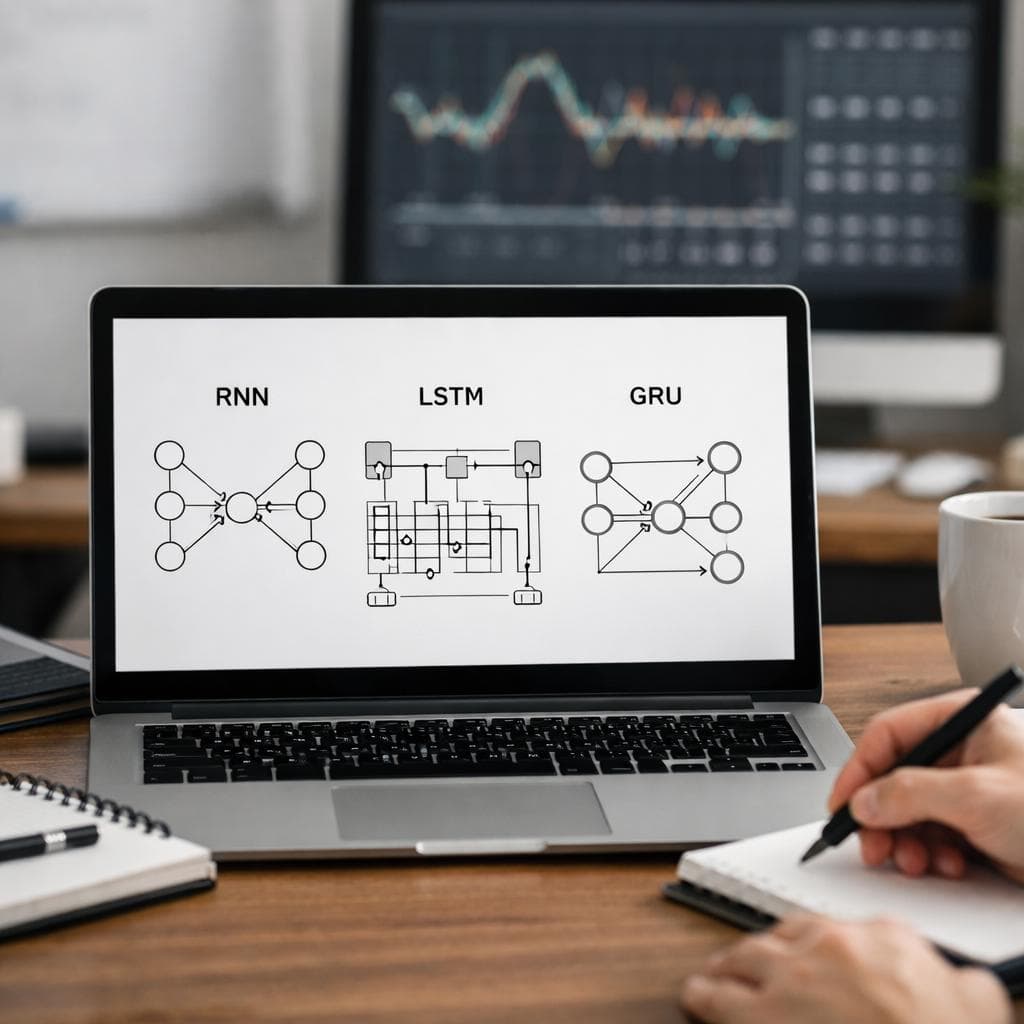

Transfer learning i fine-tuning bywają używane zamiennie, jednak w rzeczywistości różnią się zakresem oraz wpływem na efektywność wdrożeń AI. Dla firm i startupów decyzja, które podejście wybrać, przekłada się bezpośrednio na koszty, czas wdrożenia i jakość końcowego rozwiązania. W sektorach takich jak medycyna, e-commerce czy finanse, gdzie dostęp do danych bywa ograniczony, właściwe wykorzystanie tych technik może przesądzić o sukcesie projektu. Warto zauważyć, że w obszarach związanych z analizą tekstu, takich jak Natural Language Processing, wybór odpowiedniego podejścia może mieć szczególnie duże znaczenie dla skuteczności modeli AI. W 2026 roku, gdy gotowe modele (np. GPT-4, BERT, CLIP) są szeroko dostępne, umiejętność wyboru między transfer learningiem a fine-tuningiem staje się kompetencją strategiczną dla zespołów AI.Techniczne różnice: jak przebiega proces?

Transfer learning polega na wykorzystaniu wiedzy z modelu wytrenowanego na jednym zadaniu i zastosowaniu jej do nowego, często pokrewnego problemu. Fine-tuning to krok dalej – polega na częściowym lub pełnym dostosowaniu już wytrenowanego modelu do bardzo konkretnego zadania, najczęściej poprzez dalszy trening na nowych danych. Przykładowo, korzystając z ResNet-50 wytrenowanego na ImageNet, firma może zastosować transfer learning do klasyfikacji nowych kategorii obrazów, a fine-tuning – by osiągnąć wyższą precyzję na własnym, specyficznym zbiorze (np. zdjęcia medyczne). W praktyce transfer learning minimalizuje potrzebę dużej liczby specjalistycznych danych, natomiast fine-tuning pozwala na maksymalne dopasowanie modelu do wymagań biznesowych.Tabela porównawcza: transfer learning vs. fine-tuning

| Cecha | Transfer learning | Fine-tuning |

|---|---|---|

| Proces | Wykorzystanie gotowego modelu bez modyfikacji lub z minimalnymi zmianami | Dalszy trening modelu na nowych, specyficznych danych |

| Wymagania dotyczące danych | Niewielka ilość danych specyficznych | Większa liczba danych z danej domeny |

| Koszt obliczeniowy | Niski – szybka implementacja | Wyższy – wymaga dodatkowego treningu |

| Elastyczność | Ograniczona – model mniej dopasowany do specyfiki zadania | Wysoka – model precyzyjnie dostosowany |

| Zastosowania biznesowe | Prototypowanie, szybkie MVP, ograniczone budżety | Produkcja, wymagania branżowe, przewaga konkurencyjna |

Zalety i ograniczenia transfer learningu w kontekście biznesowym

Uczenie transferowe w 2026 roku stało się narzędziem, które realnie zmienia sposób wdrażania AI w firmach – zarówno tych dużych, jak i startupach. W biznesie liczy się czas wdrożenia, koszty i przewaga konkurencyjna. Transfer learning pozwala na przeskoczenie wielu miesięcy prac rozwojowych, co było niedostępne jeszcze kilka lat temu. W praktyce oznacza to, że firmy mogą wykorzystać gotowe modele, takie jak BERT, GPT-4 czy EfficientNet, i dostosować je do własnych potrzeb bez konieczności posiadania tysięcy oznaczonych danych.

Perspektywa decydenta biznesowego jest tu kluczowa – transfer learning umożliwia testowanie hipotez i prototypowanie rozwiązań AI w tempie, które jeszcze niedawno nie było możliwe. Deweloperzy, korzystając z bibliotek jak TensorFlow Hub czy PyTorch Hub, mają dostęp do dziesiątek tysięcy pretrenowanych modeli, co radykalnie obniża barierę wejścia dla nowych projektów. Jednak każda decyzja wiąże się z kompromisami – nie każdy model da się efektywnie zaadaptować, a ryzyko tzw. negatywnego transferu może zniweczyć oczekiwane korzyści.

Ograniczenia transfer learningu ujawniają się szczególnie tam, gdzie domena docelowa znacząco różni się od tej, na której model był trenowany. Przykładowo, próba adaptacji modelu rozpoznającego obrazy z domeny medycznej do analizy zdjęć przemysłowych często przynosi gorsze rezultaty niż budowa modelu od podstaw. Z punktu widzenia firmy ważne są także aspekty licencyjne i bezpieczeństwa danych – nie każdy pretrenowany model można użyć komercyjnie lub bez ryzyka naruszenia prywatności.

- Oszczędność czasu i kosztów – skrócenie wdrożenia AI z miesięcy do tygodni dzięki gotowym modelom (np. ResNet, T5, YOLOv8).

- Lepsze wyniki przy ograniczonych danych – transfer learning pozwala trenować modele nawet przy niewielkiej liczbie przykładów.

- Łatwiejsza adaptacja do nowych zastosowań – szybkie prototypowanie rozwiązań dla różnych branż i problemów biznesowych.

- Ryzyko negatywnego transferu – nieprawidłowe dopasowanie modelu może pogorszyć jakość predykcji.

- Ograniczenia licencyjne i kwestie etyczne – nie każdy model można legalnie lub bezpiecznie wykorzystać komercyjnie.

- Problemy z biasem – przeniesienie uprzedzeń z oryginalnych danych może prowadzić do niepożądanych rezultatów w nowych aplikacjach.

- Trudności przy dużych różnicach domenowych – efektywność transfer learningu maleje, gdy domena źródłowa i docelowa są zbyt różne.

W kontekście biznesowym decyzja o wdrożeniu transfer learningu powinna być poprzedzona analizą ryzyk oraz potencjału adaptacji wybranego modelu. Świadome zarządzanie tym procesem pozwala osiągnąć wymierne korzyści, ale wymaga kompetencji zarówno technicznych, jak i biznesowych.

Praktyczne zastosowania transfer learningu – przykłady 2026

Uczenie transferowe w 2026 roku jest fundamentem wdrażania AI w firmach, które chcą szybko osiągnąć wyniki bez inwestowania milionów w zbieranie danych i budowę modeli od podstaw. Dla właścicieli biznesów, CTO czy product managerów liczy się czas do wdrożenia – transfer learning pozwala skrócić go nawet o 70% w porównaniu z klasycznym trenowaniem modeli. Przykład: wdrożenie modelu rozpoznawania obrazów w e-commerce na bazie gotowego modelu ResNet50 w PyTorch pozwala osiągnąć wysoką skuteczność przy minimalnej liczbie własnych zdjęć produktowych.

W 2026 roku firmy korzystają z transfer learningu nie tylko w klasycznych zadaniach, jak analiza obrazu czy tekstu. Przykłady to personalizacja ofert w bankowości (wykorzystanie modeli językowych, np. Llama 3, do analizy zapytań klientów) czy automatyczna moderacja treści w social media (adaptacja modeli ViT lub EfficientNet z Keras do detekcji niepożądanych materiałów). W cyberbezpieczeństwie narzędzia takie jak TensorFlow Extended wspierają detekcję nowych typów ataków, nawet gdy firma dysponuje ograniczonymi danymi o incydentach.

Lista obszarów biznesowych i branż, gdzie transfer learning przynosi realne korzyści:

- Medycyna: analiza obrazów medycznych (np. MRI, RTG) z wykorzystaniem modeli pretrenowanych na dużych zbiorach, co przyspiesza diagnostykę i ogranicza koszt anotacji.

- E-commerce: automatyczne kategoryzowanie produktów i rekomendacje oparte na transferze wiedzy z dużych modeli wizualnych i językowych.

- Czytanie dokumentów i OCR: adaptacja modeli do specyficznych szablonów faktur, umów czy dokumentów prawnych.

- Cyberbezpieczeństwo: transfer modeli do detekcji anomalii w sieci i wykrywania nowych zagrożeń na podstawie ograniczonych próbek.

- Marketing: analiza sentymentu klientów i personalizacja kampanii z użyciem modeli NLP, trenowanych na publicznych korpusach i dostosowanych do branży.

- Finanse: wykrywanie nadużyć i fraudów dzięki transferowi modeli z innych rynków lub segmentów.

Z mojego doświadczenia: "Największe zaskoczenie? Małe polskie startupy wdrażają transfer learning szybciej niż korporacje, bo nie mają oporu przed korzystaniem z otwartych modeli. Widzę, jak kilkadziesiąt linii kodu w PyTorch czy TensorFlow realnie zmienia ich produkty w kilka tygodni." Ta elastyczność i dostępność narzędzi sprawia, że transfer learning jest dziś narzędziem nie tylko dla gigantów, ale i dla każdej firmy, która myśli o skalowaniu AI bez zbędnych kosztów.

Wyzwania i pułapki transfer learningu – czego unikać w praktyce

Transfer learning otwiera nowe możliwości, ale w praktyce bywa źródłem zaskakujących problemów. Dla firm, które chcą szybko wdrożyć rozwiązania AI, nieprzemyślane użycie gotowych modeli może skutkować stratą czasu, zasobów lub wręcz pogorszeniem wyników. Najwięcej wyzwań pojawia się, gdy domena źródłowa i docelowa różnią się znacznie – na przykład przenosząc model wizji komputerowej z branży medycznej do analizy obrazów przemysłowych. Z tego powodu warto świadomie ocenić, czy transfer learning rzeczywiście pasuje do konkretnego zadania i jakich pułapek unikać.

W 2026 roku problemem nie są już tylko dane czy moc obliczeniowa, lecz umiejętność właściwego doboru architektury, strategii transferu oraz narzędzi. Przykładowo, korzystając z modeli takich jak BERT, GPT-4 czy ResNet, łatwo przeoczyć różnice w dystrybucji danych lub specyfice zadania. W rezultacie rezultaty mogą odbiegać od oczekiwań, a zespół IT traci czas na debugowanie nieintuicyjnych błędów. Dla startupów oznacza to ryzyko nietrafionych inwestycji, a dla dużych firm – utratę przewagi konkurencyjnej.

Odpowiedzialność za sukces wdrożenia AI spoczywa zarówno na zespołach technicznych, jak i decydentach biznesowych. Brak zrozumienia ograniczeń transferowanych modeli, zbyt pochopne zaufanie do "pre-trained" rozwiązań czy niedostosowanie procesu fine-tuningu do własnych danych – każdy z tych błędów może mieć realne konsekwencje finansowe i wizerunkowe. Praktyka pokazuje, że najlepsze rezultaty osiągają zespoły, które regularnie walidują modele na własnych zbiorach i uważnie analizują metryki, zamiast polegać wyłącznie na wynikach benchmarkowych.

- Negative transfer – przeniesienie wiedzy z modelu źródłowego pogarsza wyniki w nowej domenie (np. różne rozkłady danych, niezgodność cech).

- Overfitting przy fine-tuningu – zbyt intensywne dostosowanie modelu do małego zbioru danych docelowych prowadzi do utraty ogólności.

- Błędny dobór modelu bazowego – wybór architektury niepasującej do zadania (np. model NLP do klasyfikacji obrazów).

- Ignorowanie biasu w danych – transferuje się nie tylko wiedzę, ale też uprzedzenia obecne w danych źródłowych (np. dyskryminacja grup użytkowników).

- Niedostosowanie hiperparametrów – kopiowanie ustawień z oryginalnego zadania bez walidacji na własnych danych często obniża skuteczność.

- Problemy licencyjne – wykorzystanie modeli objętych restrykcyjnymi licencjami (np. GPL, niektóre modele OpenAI) może być niezgodne z polityką firmy.

- Niedoszacowanie wymagań sprzętowych – duże modele, takie jak Llama 3 czy ViT, wymagają zasobów, których nie uwzględniono na etapie planowania.

- Niezgodność frameworków – nie wszystkie modele z TensorFlow można łatwo przenieść do PyTorch lub odwrotnie, co komplikuje wdrożenia hybrydowe.

W praktyce najskuteczniejsze zespoły regularnie testują modele na danych reprezentatywnych dla własnego biznesu, stosują walidację krzyżową i analizują metryki specyficzne dla zadania. Użycie narzędzi takich jak TensorBoard, Weights & Biases czy MLflow pozwala monitorować proces transferu i szybko wykrywać niepożądane efekty. To podejście minimalizuje ryzyko negatywnego transferu i pozwala w pełni wykorzystać potencjał transfer learningu w realnych zastosowaniach biznesowych.

Frameworki i narzędzia do transfer learningu – przegląd i porównanie

| Framework | Łatwość użycia | Wsparcie społeczności | Dostępne modele pre-trenowane | Dokumentacja |

|---|---|---|---|---|

| TensorFlow | Średnia/Zaawansowana | Bardzo duże | Około 150+ (TF Hub, Model Zoo) | Bardzo obszerna, oficjalna i społecznościowa |

| PyTorch | Średnia | Duże, dynamiczne | 120+ (Torch Hub, torchvision) | Intuicyjna, przykłady kodu, aktywne forum |

| Keras | Bardzo łatwa | Duże, przyjazne dla początkujących | 50+ (Keras Applications, integracja z TF Hub) | Prosta, zrozumiała, liczne tutoriale |

Refleksja eksperta: Jak transfer learning zmienia realia wdrożeń AI w 2026 roku?

Nowe standardy wdrożeń: szybkość, koszt, dostępność

Transfer learning w 2026 roku całkowicie przeorganizował procesy wdrożeń AI w firmach. Jeszcze kilka lat temu projekty AI wymagały zespołów badawczych, ogromnych zbiorów danych i miesięcy eksperymentów. Dziś, wykorzystując gotowe modele jak GPT-4o, Llama 3 czy EfficientNetV2, nawet startupy mogą wdrażać zaawansowane rozwiązania w tygodnie, a nie miesiące. Przykładowo, wdrożenie własnego systemu rekomendacji opartego na transfer learningu to koszt rzędu 20–30 tys. zł, podczas gdy budowa od zera to kwoty przekraczające 200 tys. zł. Ten przeskok obniżył barierę wejścia do AI dla firm o różnej skali i pozwolił na testowanie prototypów bez ogromnych inwestycji.Biznes, technologia i bariery mentalne – kto zyskuje najwięcej?

Transfer learning nie jest już domeną tylko dużych korporacji. Małe i średnie firmy, które kiedyś nie miały szans konkurować w obszarze AI, dziś korzystają z modeli dostępnych w TensorFlow Hub, Hugging Face lub PyTorch Model Zoo. Najwięcej zyskują organizacje, które potrafią szybko adaptować gotowe rozwiązania i łączyć kompetencje IT z wiedzą branżową. W praktyce, firmy e-commerce wdrażają personalizację w oparciu o przetrenowane modele NLP, a sektor medyczny korzysta z transfer learningu do analizy obrazów w diagnostyce. Jedyną realną barierą pozostaje mentalność – nie każda organizacja jest gotowa na zmianę podejścia do rozwoju AI i przejście od "budujemy wszystko sami" do "adaptujemy i optymalizujemy".Co zmienia transfer learning w strategiach rozwoju AI?

Z perspektywy decydentów i liderów IT, transfer learning przesuwa ciężar inwestycji z infrastruktury i danych na kompetencje w zakresie adaptacji modeli. Największą przewagą staje się umiejętność wyboru właściwego modelu bazowego oraz właściwego fine-tuningu pod dane firmowe. W 2026 roku firmy coraz częściej budują własne, hybrydowe modele, łącząc transfer learning z uczeniem federacyjnym czy technikami domain adaptation. Pojawia się też nowy wymiar odpowiedzialności: kwestie licencji, prywatności i bias w modelach transferowanych stają się kluczowe w ocenie ryzyka biznesowego. Dla firm oznacza to konieczność inwestycji nie tylko w technologię, ale także w procesy audytu i governance AI.Podsumowanie

Transfer learning to rewolucyjna technika, która pozwala firmom przenosić wiedzę z gotowych modeli AI i błyskawicznie wdrażać własne rozwiązania. Artykuł wyjaśnia, jak działa uczenie transferowe, czym różni się od fine-tuningu i dlaczego w 2026 roku stało się fundamentem efektywnego rozwoju produktów cyfrowych. Poznasz różne typy transfer learningu, praktyczne wyzwania oraz pułapki, które mogą zaskoczyć nawet doświadczone zespoły. Dowiesz się, które frameworki – TensorFlow, PyTorch, Keras – dominują na rynku i jak wykorzystać je w praktyce. Zyskasz konkretną wiedzę, która pozwoli podejmować świadome decyzje technologiczne i wyprzedzić konkurencję.

Najczesciej zadawane pytania

Czy transfer learning można wykorzystać poza uczeniem maszynowym, np. w innych dziedzinach technologii?

Jakie są najczęstsze błędy popełniane podczas wdrażania transfer learningu w firmach?

Czy transfer learning wymaga dużych zasobów obliczeniowych?

Jak sprawdzić, czy transfer learning poprawił wyniki modelu w moim projekcie?

Czy mogę wykorzystać transfer learning w projektach związanych z przetwarzaniem języka polskiego?